Receba insights da Kinea exclusivos diretamente no seu e-mail.

Assine nossa

newsletter.

Ao assinar a newsletter, você aceita receber comunicados da Kinea e concorda com nossa Política de Privacidade.

As gigantes da tecnologia e a disputa pela vanguarda em IA

O filme “O Jogo da Imitação”, estrelado por Benedict Cumberbatch, conta a história de um dos maiores feitos da Segunda Guerra Mundial: a corrida contra o tempo de Alan Turing e sua equipe para quebrar o código Enigma.

O Enigma era a máquina que os nazistas utilizavam para criptografar suas mensagens, de forma que os aliados não pudessem lê-las. Decifrar o Enigma levaria à salvação de milhões de vidas e à provável vitória sobre a Alemanha de Hitler.

O Enigma era a máquina que os nazistas utilizavam para criptografar suas mensagens, de forma que os aliados não pudessem lê-las. Decifrar o Enigma levaria à salvação de milhões de vidas e à provável vitória sobre a Alemanha de Hitler.

Alan Turing, o decifrador do Enigma, também é conhecido como o pai da Inteligência Artificial, pelo seu trabalho pioneiro no setor. Ele propôs o famoso “Teste de Turing”, para medir se uma máquina poderia ter respostas similares às de um humano, e desenvolveu o conceito das “Máquinas de Turing”, que serviram como base para a criação da computação moderna.

O Enigma moderno

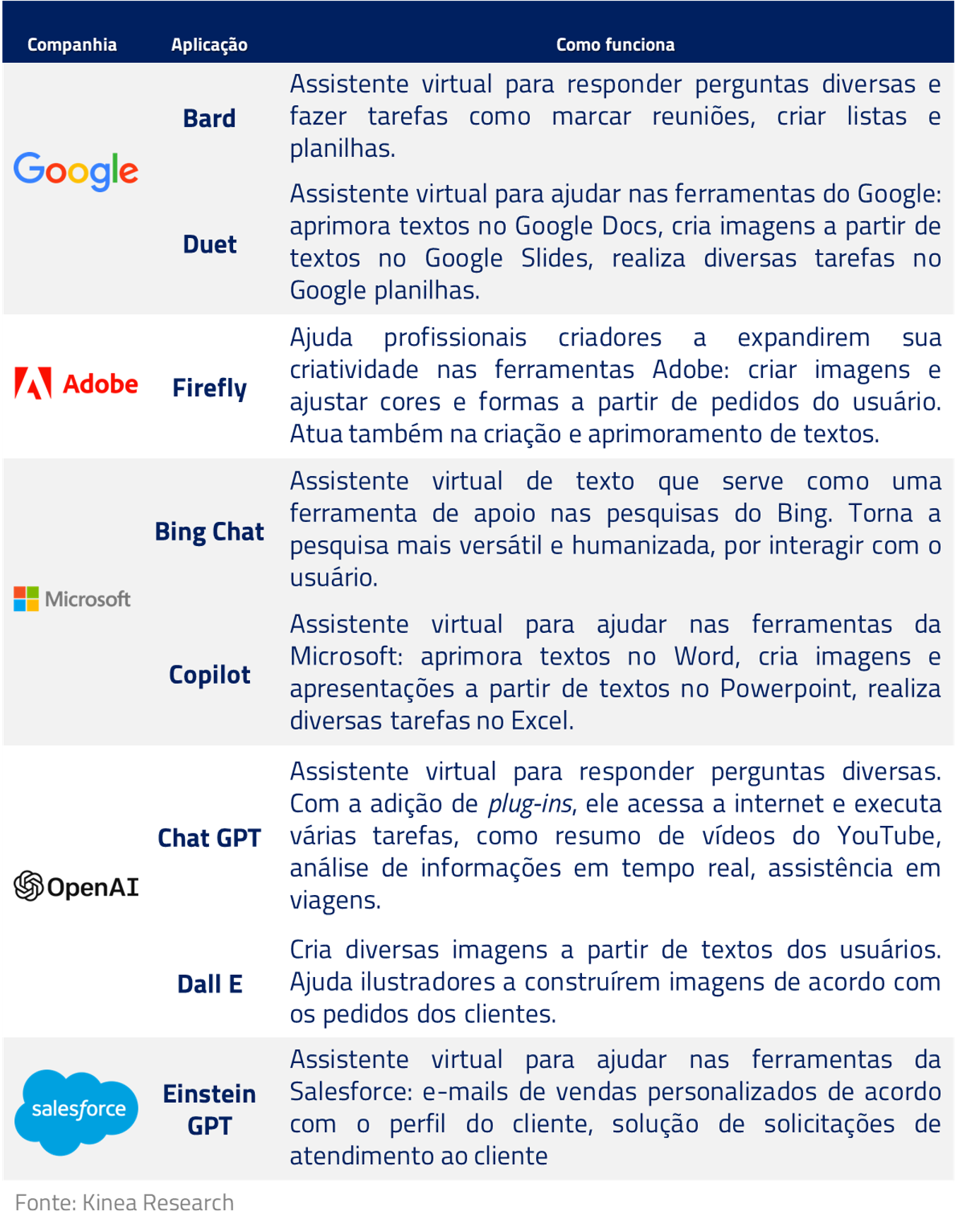

Hoje, as grandes empresas de tecnologia se encontram em uma corrida contra um novo “Enigma”: desenvolver soluções de equipamentos, infraestrutura, chips e aplicativos para a nascente indústria de inteligência artificial. Em um ambiente de alta competição, quem serão os vencedores?

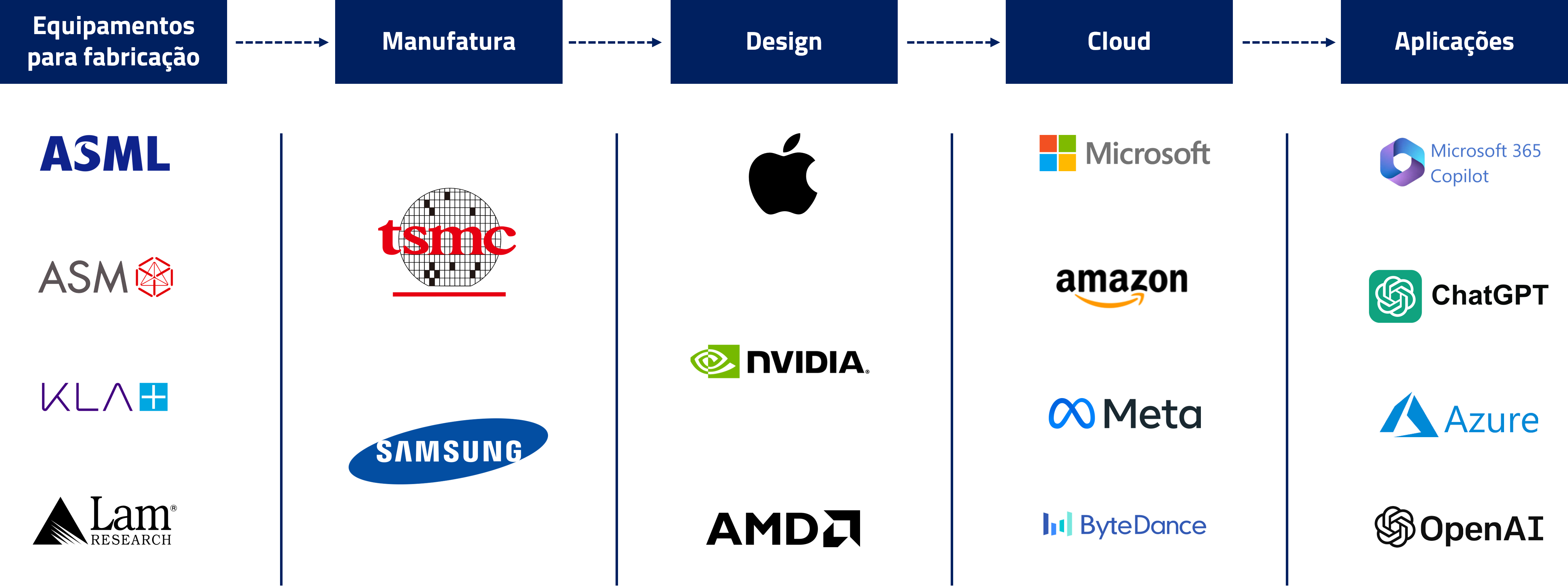

Nesse quebra-cabeça, empresas como ASML são fundamentais na fabricação do equipamento para a manufatura dos processadores, enquanto Nvidia e AMD desenham os processadores necessários para se treinar os modelos complexos de IA. As empresas de cloud como Amazon e Microsoft fornecem a infraestrutura para esses modelos. No final dessa cadeia, nascem as novas aplicações de IA, tais como o Chat GPT e o novo Copilot da Microsoft.

Nesse Kinea Insights, vamos apresentar as principais partes da cadeia de empresas que participam desse processo, e destacaremos onde vemos valor para os nossos portfólios, bem como nossa visão dos futuros desdobramentos dessa indústria.

Esse é o nosso segundo Kinea Insights sobre o tema da inteligência artificial. Caso tenha interesse em conhecer os conceitos básicos desse setor, descrevemos os mesmos, juntamente com nosso estudo de caso da Nvidia, no nosso Insights “O Exterminador do Futuro”.

Qual o tamanho potencial do mercado de IA?

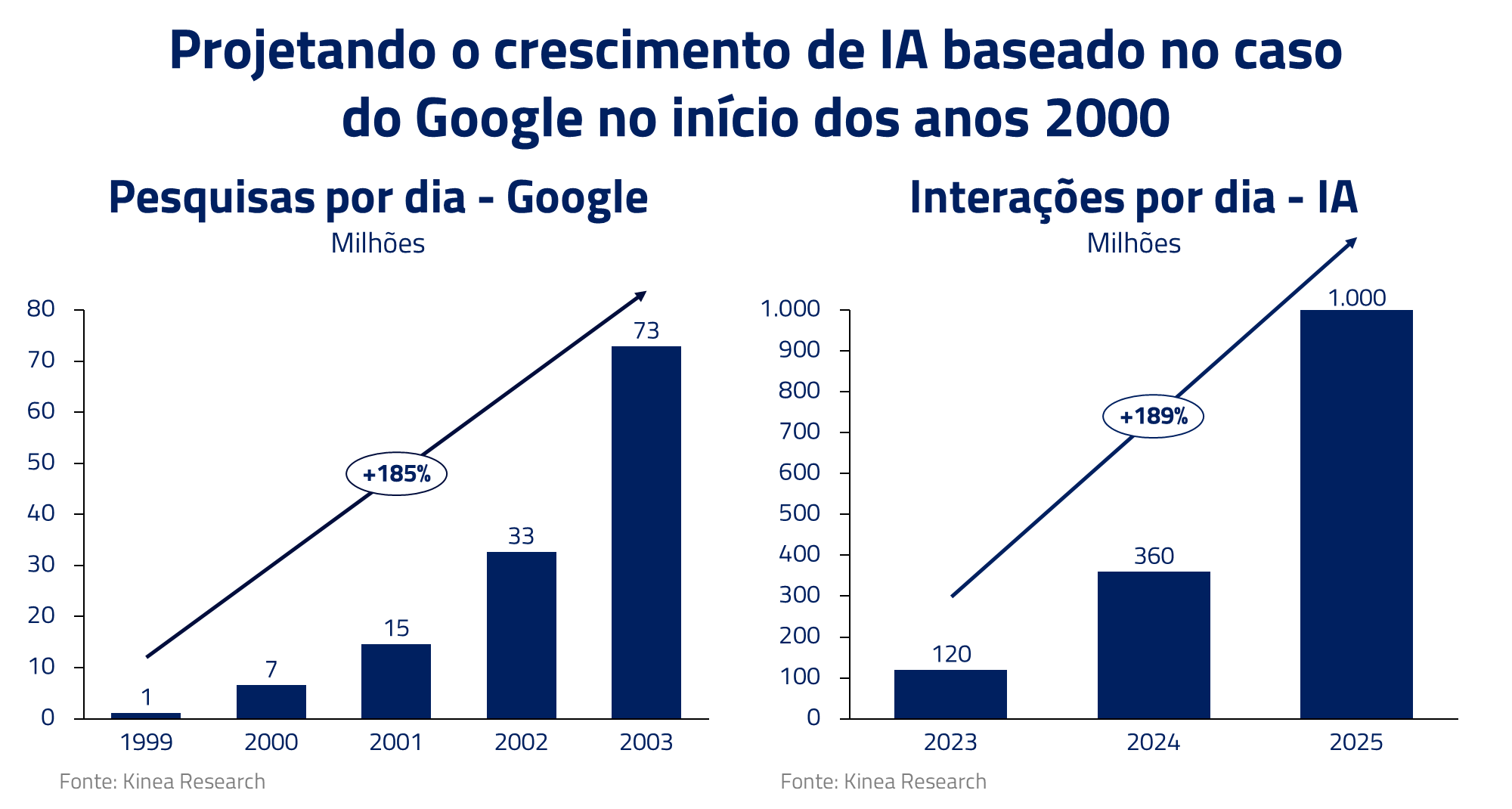

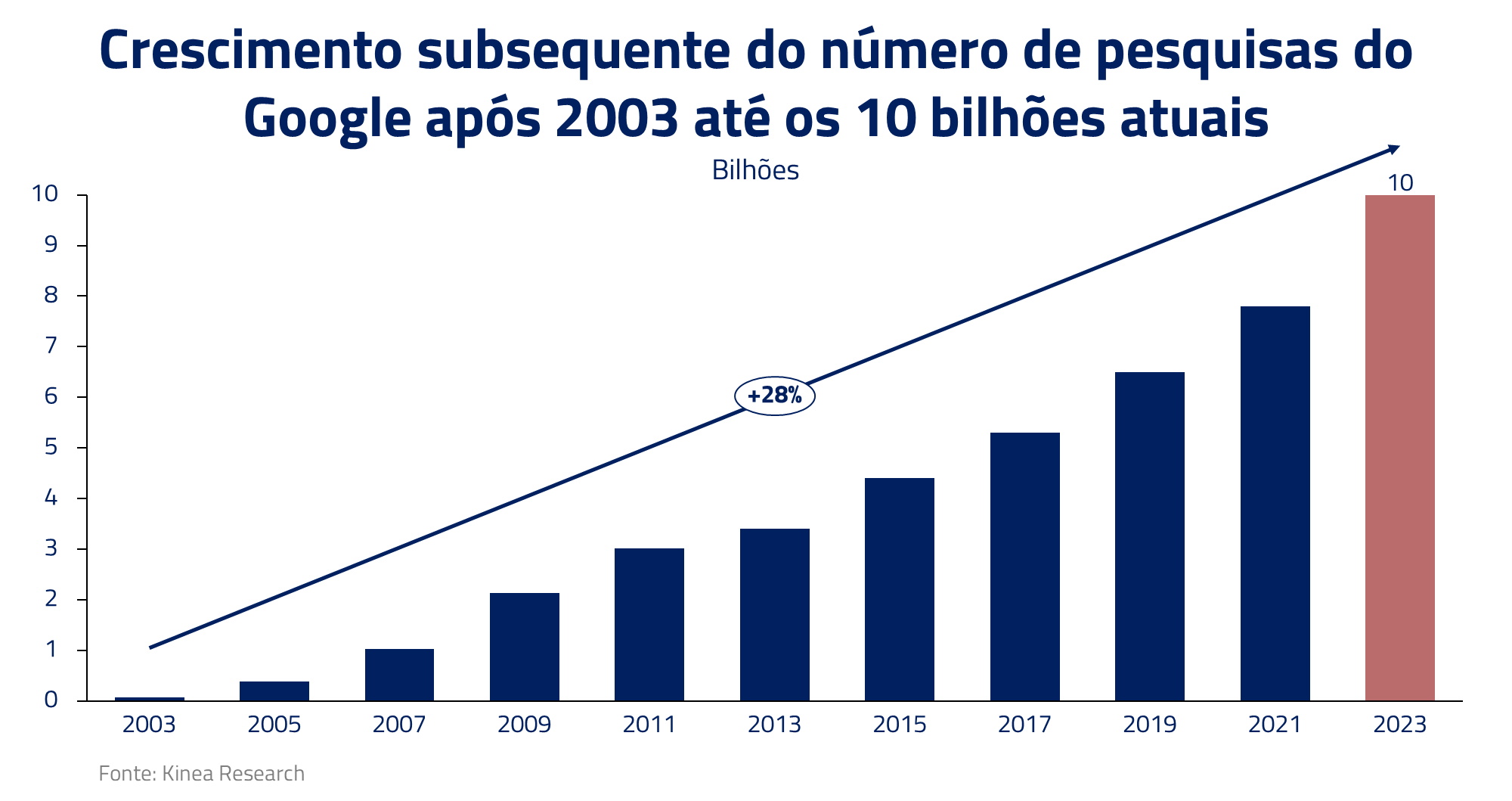

Para podermos traduzir o que seria o mercado potencial de IA, decidimos tomar como base o mercado de Search na internet. Hoje, o Google recebe cerca de 10 bilhões de perguntas por dia ao redor do planeta. Qual seria o tamanho razoável que deveríamos esperar para o mercado de IA?

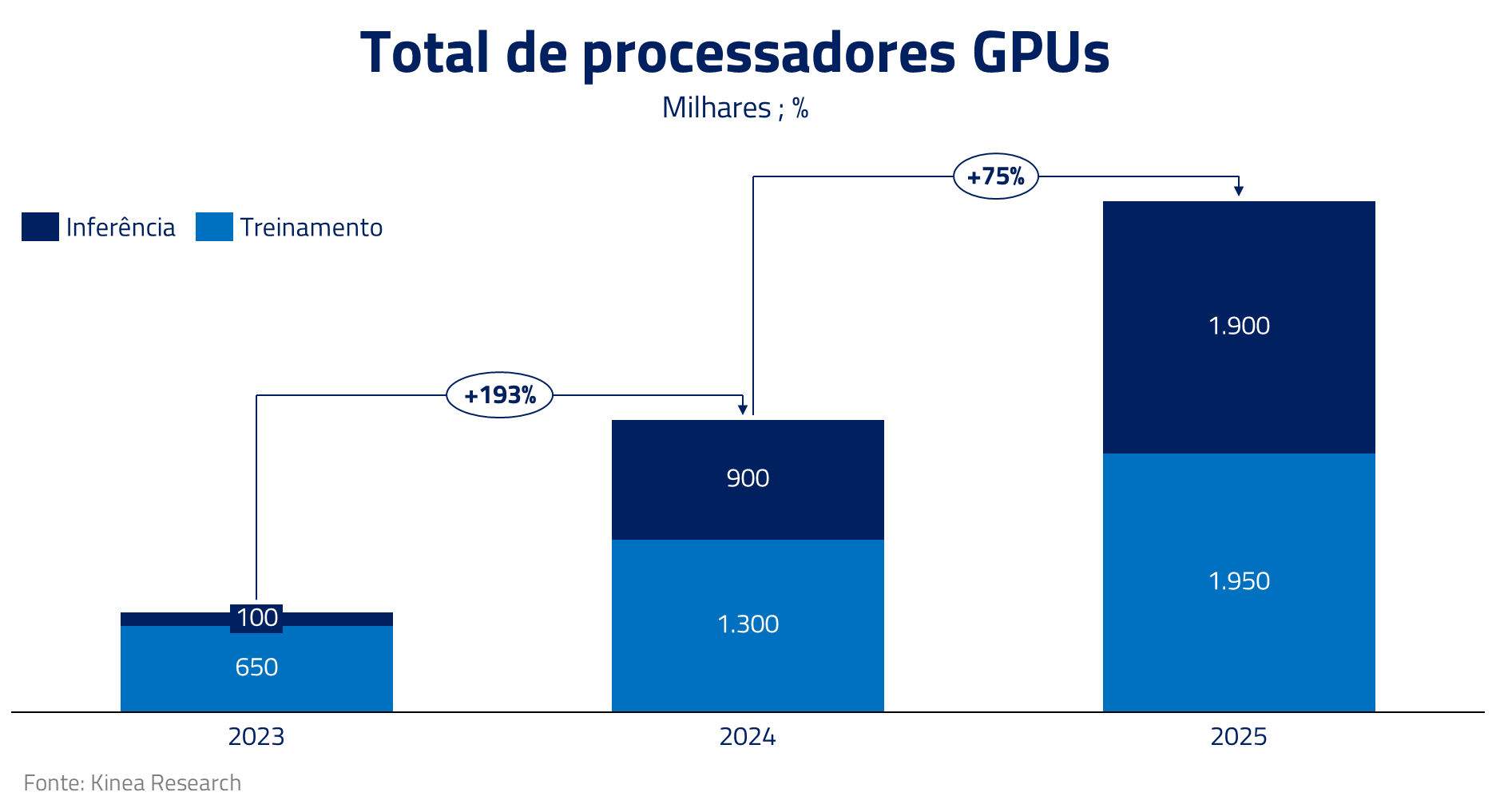

Hoje, muitos de nós na Kinea já interagimos mais com ferramentas de inteligência artificial do que de puramente Search. No decorrer desse documento, vamos tomar como base um cenário onde, inicialmente, trabalharemos com 1 bilhão de interações diárias, ou 10% do total de pesquisas de search, o que consideramos bastante conservador vis-à-vis o potencial dessa nova tecnologia.

Para atingirmos esse número de 1 bilhão de interações de IA, consideramos que a nova tecnologia apresentará crescimento similar à de Search quando introduzida no início dos anos 2000. Dessa forma, chegaríamos a esse número por volta de 2025.

Esse elevado número de interações deve requerer um crescimento substancial na infraestrutura presente para o setor. Desde processadores de IA, as chamadas GPUs, até crescimento de servidores nas empresas de computação na nuvem para atender aos usuários finais.

Para entendermos essas necessidades, vamos começar estimando o número de processadores (GPUs) necessários. E, nesse caso, nossa primeira empresa a ser analisada será a Nvidia.

Decifrando o enigma da Nvidia

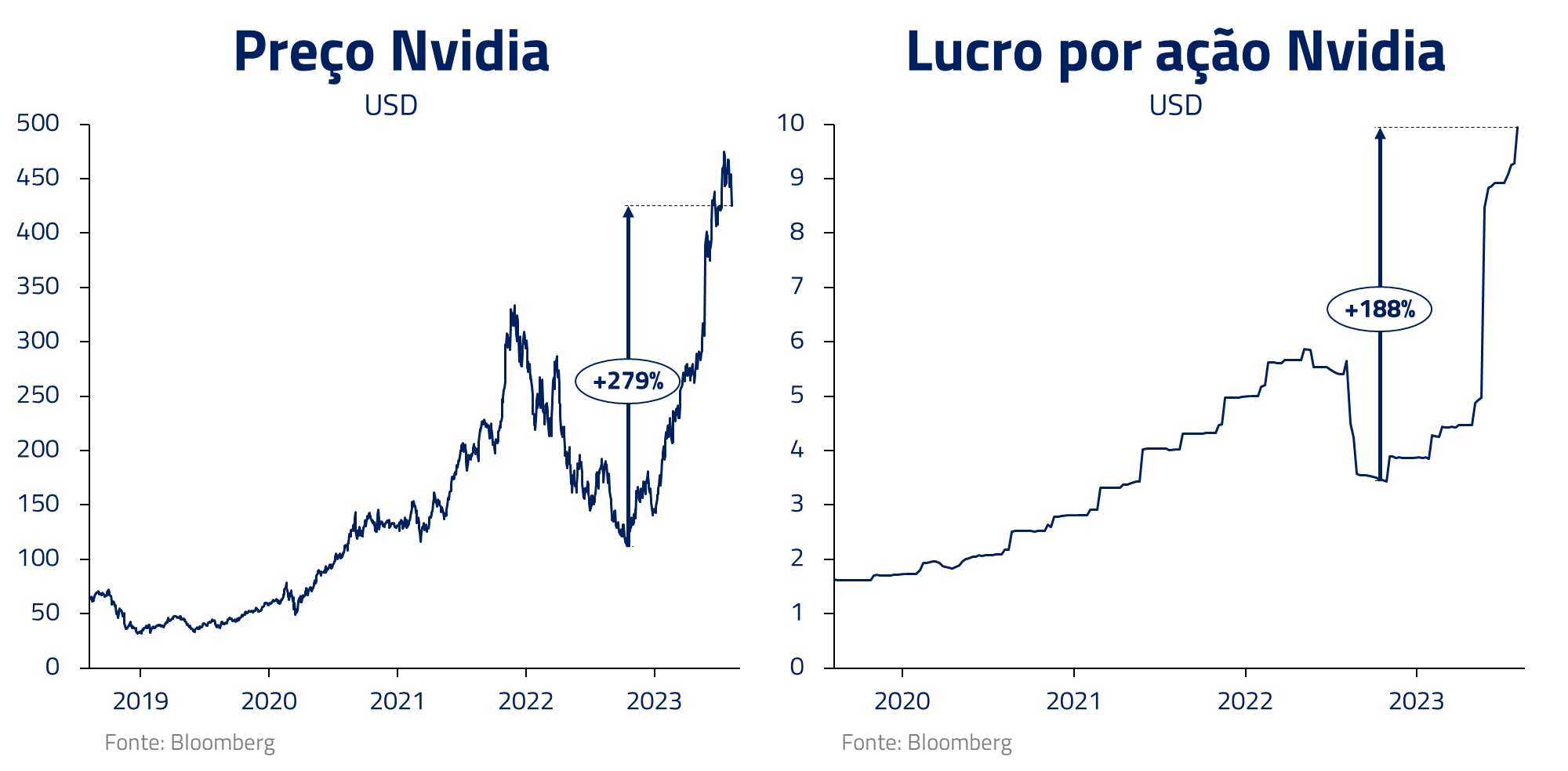

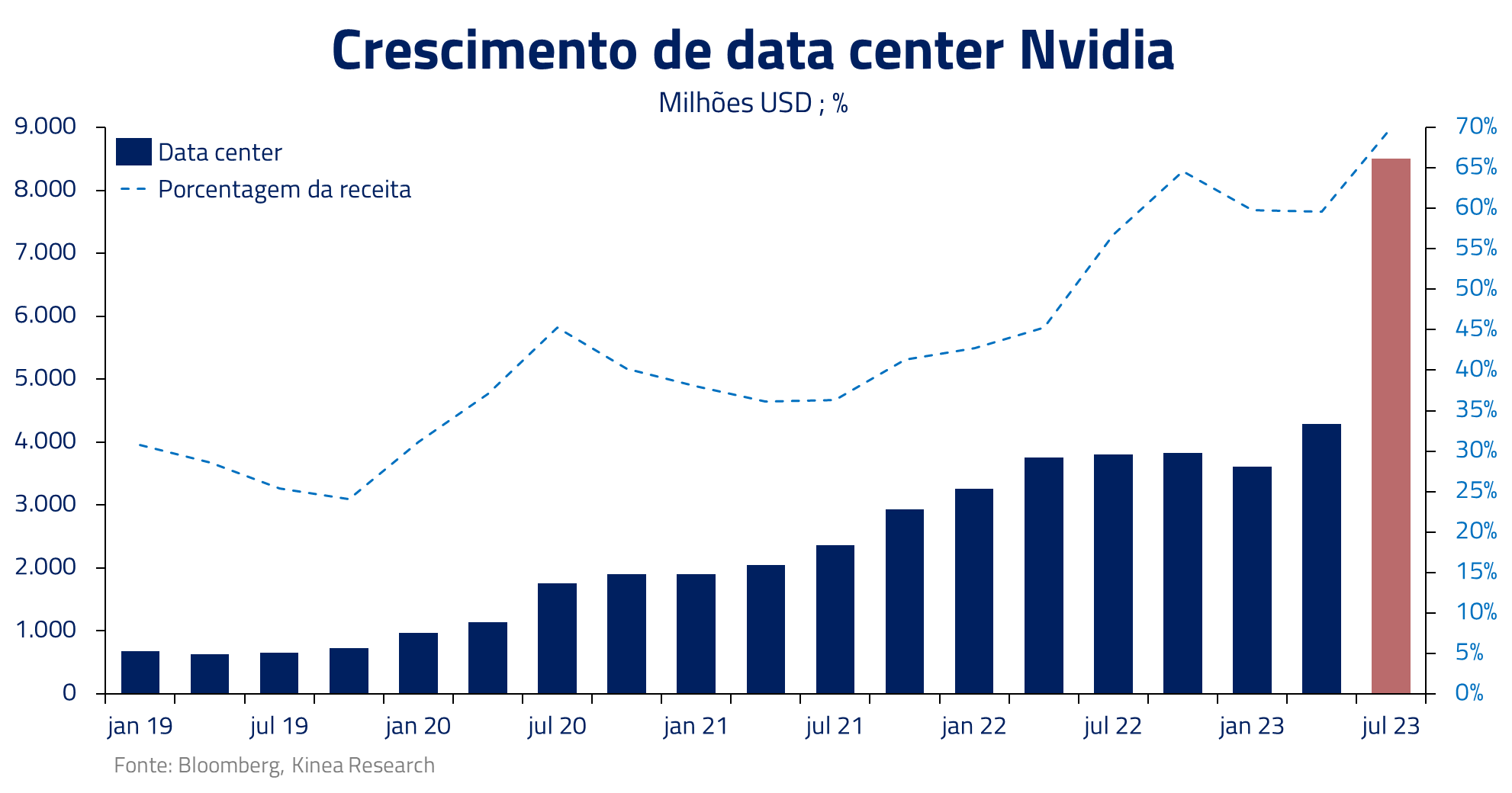

Dentre todas as empresas envolvidas no processo de IA, Nvidia sem dúvida foi o maior fenômeno de transformação e performance.

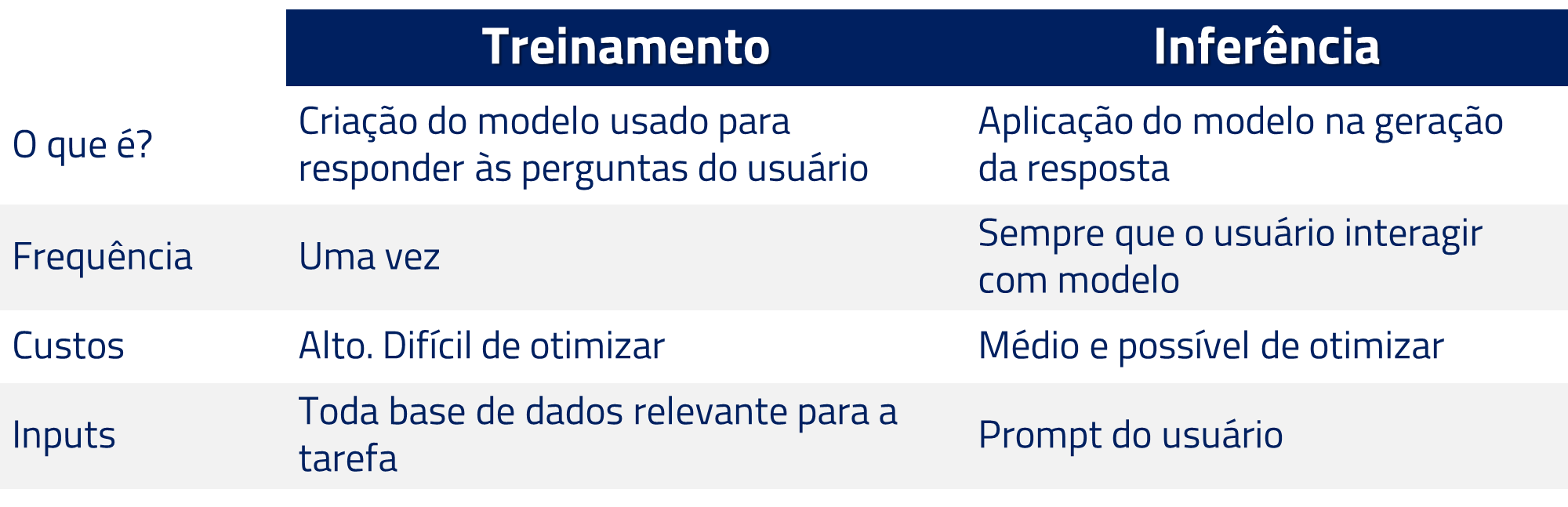

O processo de criação de modelos de IA envolve dois processos: treinamento e aplicação, ambos necessitam da tecnologia da Nvidia, juntamente com um enorme número de processadores GPU.

O crescimento de vendas atual e projetado é transformacional para a empresa. Entre os processadores A100 e H100, as GPUs mais modernas, o crescimento guiado pela empresa para o 2º trimestre é de cerca de 100% comparado ao 1º trimestre de 2023.

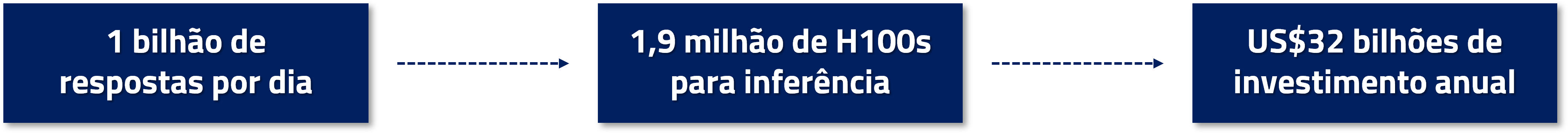

Olhando além do próximo trimestre, pensamos qual seria a demanda final de GPUs para a Nvidia considerando os desenvolvimentos que imaginamos para a indústria. Assumindo que a interação com modelos de IA chegue a 1 bilhão de perguntas por dia, teríamos uma necessidade de 1.9 milhão de GPUs somente para inferência.

Assumindo um preço de 25 mil dólares por GPU, teríamos um mercado de $48 bilhões de vendas. Tornando uma vida útil de 1.5 anos, teríamos uma receita potencial de $32 bilhões anuais somente com inferência.

Já para o mercado futuro de treinamento, quando chegarmos ao nosso target de 1 bilhão de interações, estimamos um potencial de 1000 modelos de LLM sendo treinados, gerando um mercado potencial de 1.95 milhão de GPUs.

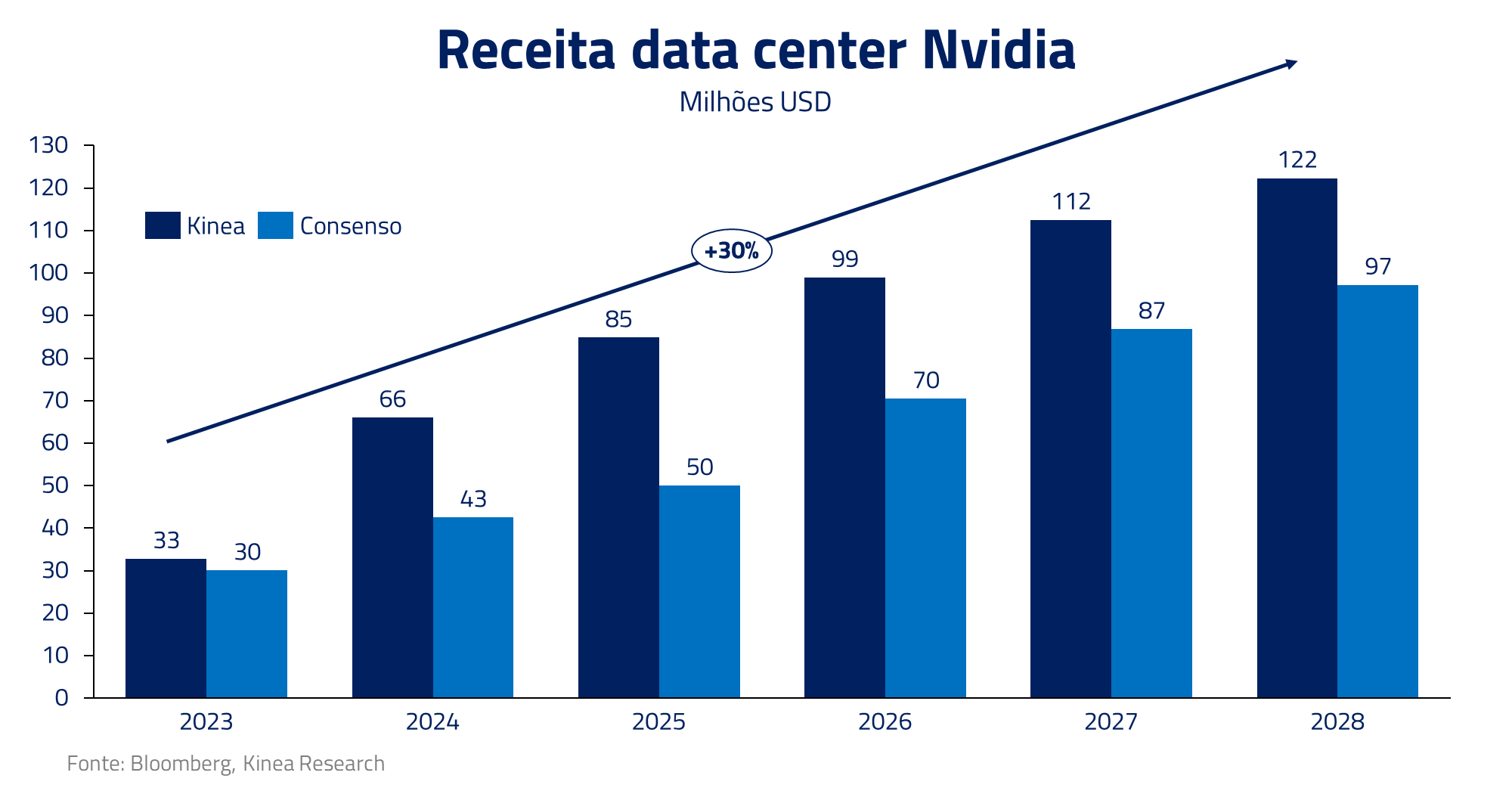

Combinando inferência e treinamento, chegamos a um mercado total estimado de quase 4 milhões de GPUs para os próximos 2 anos. Projetando a demanda futura para treinamento e inferência, acreditamos que a Nvidia possa entregar um CAGR potencial de 30% na linha de Data Center nos próximos 5 anos.

Essas estimativas nos conduzem a números que são hoje consideravelmente acima do consenso para os próximos anos. Embora seja um grande desafio projetar esses números trimestre a trimestre, fundamentalmente consideramos o potencial de médio prazo como bastante elevado e mantemos posições compradas na Nvidia.

Essas estimativas nos conduzem a números que são hoje consideravelmente acima do consenso para os próximos anos. Embora seja um grande desafio projetar esses números trimestre a trimestre, fundamentalmente consideramos o potencial de médio prazo como bastante elevado e mantemos posições compradas na Nvidia.

A tecnologia da Nvidia de GPUs se encontra muito acima de seus competidores e o forte nível de demanda atual não pode ser satisfeito pela empresa em virtude de limitações na fabricante dos chips em Taiwan, a TSMC.

TSMC: a única fábrica capaz de fornecer os cobiçados chips de IA

Dentro do mercado de IA, somente uma empresa não tem concorrentes: a TSMC. Sendo a fábrica de processadores de inteligência artificial para os cobiçados chips A100 e H100, a empresa deve, ao longo dos próximos semestres, se beneficiar dessa tendência.

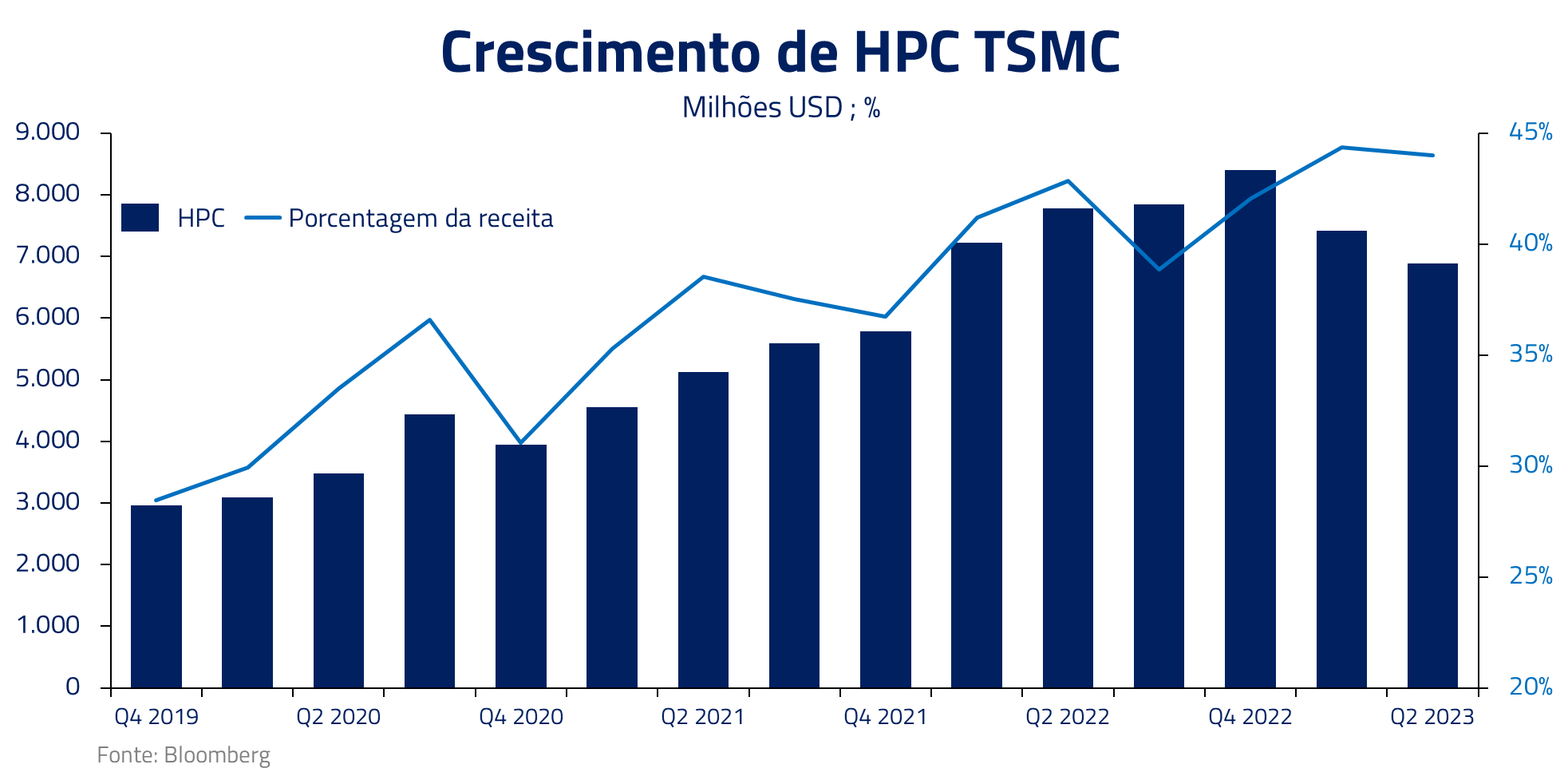

Embora IA seja responsável por somente 6% da receita da TSMC hoje, as taxas de crescimento esperadas dessa linha de receita são bastante atraentes (30% ao ano esperado pelos próximos 5 anos). De forma mais abrangente, a divisão da TSMC de High Performance Computing, onde IA está inserida, já é responsável por 44% da receita total.

Ao longo dos próximos cinco anos, esperamos que a receita de AI atinja cerca de 10% da receita total da empresa, fazendo com que o crescimento de receita possa acelerar para patamares acima de 20%.

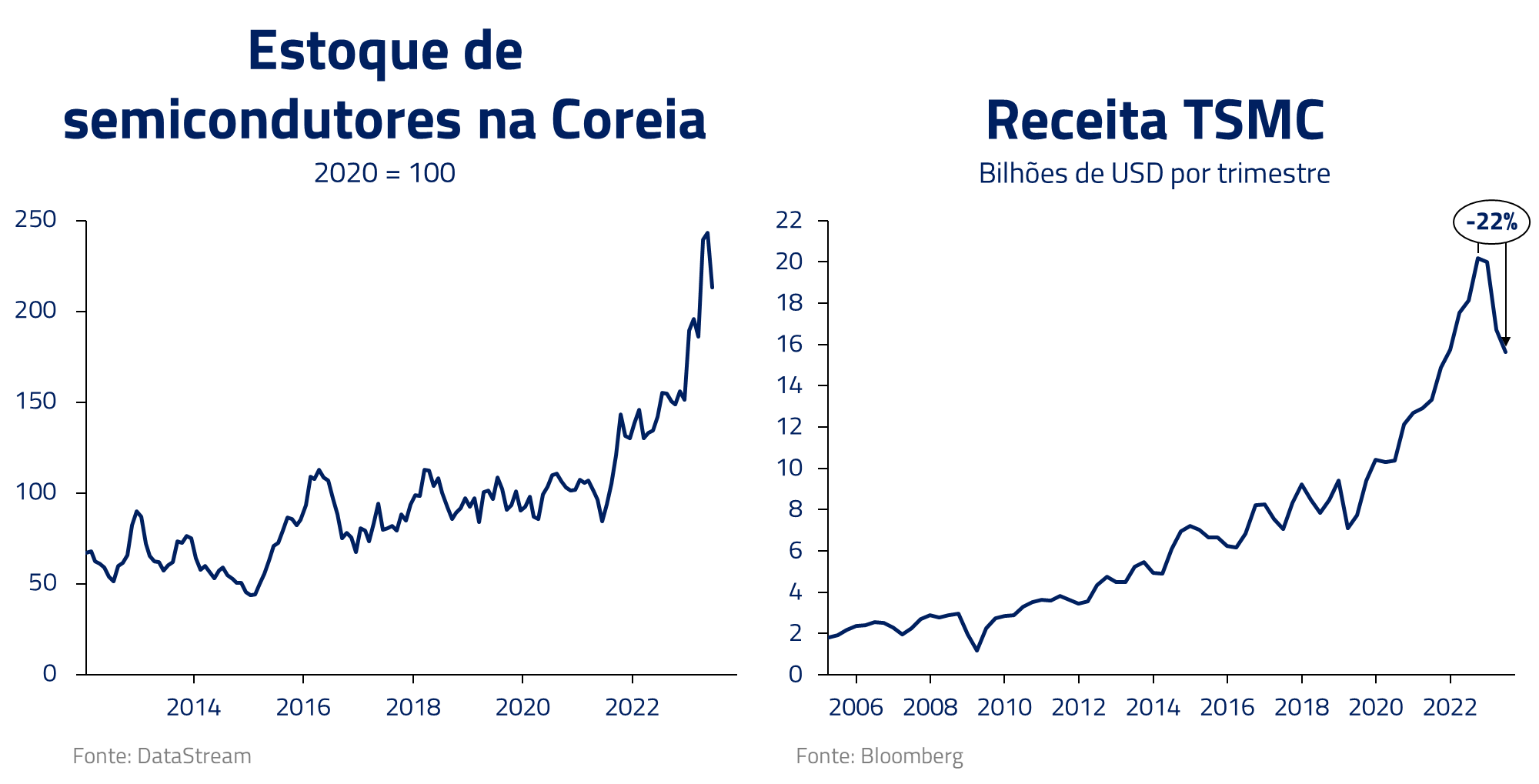

Consideramos que essa receita pode potencializar outra razão para investirmos na TSMC hoje: estamos em um momento do ciclo de semicondutores onde estoques ainda estão elevados, deprimindo vendas e, consequentemente, a valuation de empresa.

Conforme movemos para 2024, imaginamos que esse gargalo seja revertido, permitindo novamente aceleração de receita. Além disso, a empresa está em processo de ramp-up do nódulo de 3nm, a mais moderna geração de transistores e exclusiva da TSMC, cujos preços médios são aproximadamente 40% superiores à geração anterior de 5nm.

Considerando a atual valuation, na casa de 15x lucro em 2024, o potencial de crescimento em áreas como HPC e IA, somados a normalização potencial do mercado de semicondutores, vemos hoje a TSMC, líder absoluta do mercado de semicondutores de alta performance, como um investimento atraente para nossos portfólios.

As empresas de computação na nuvem

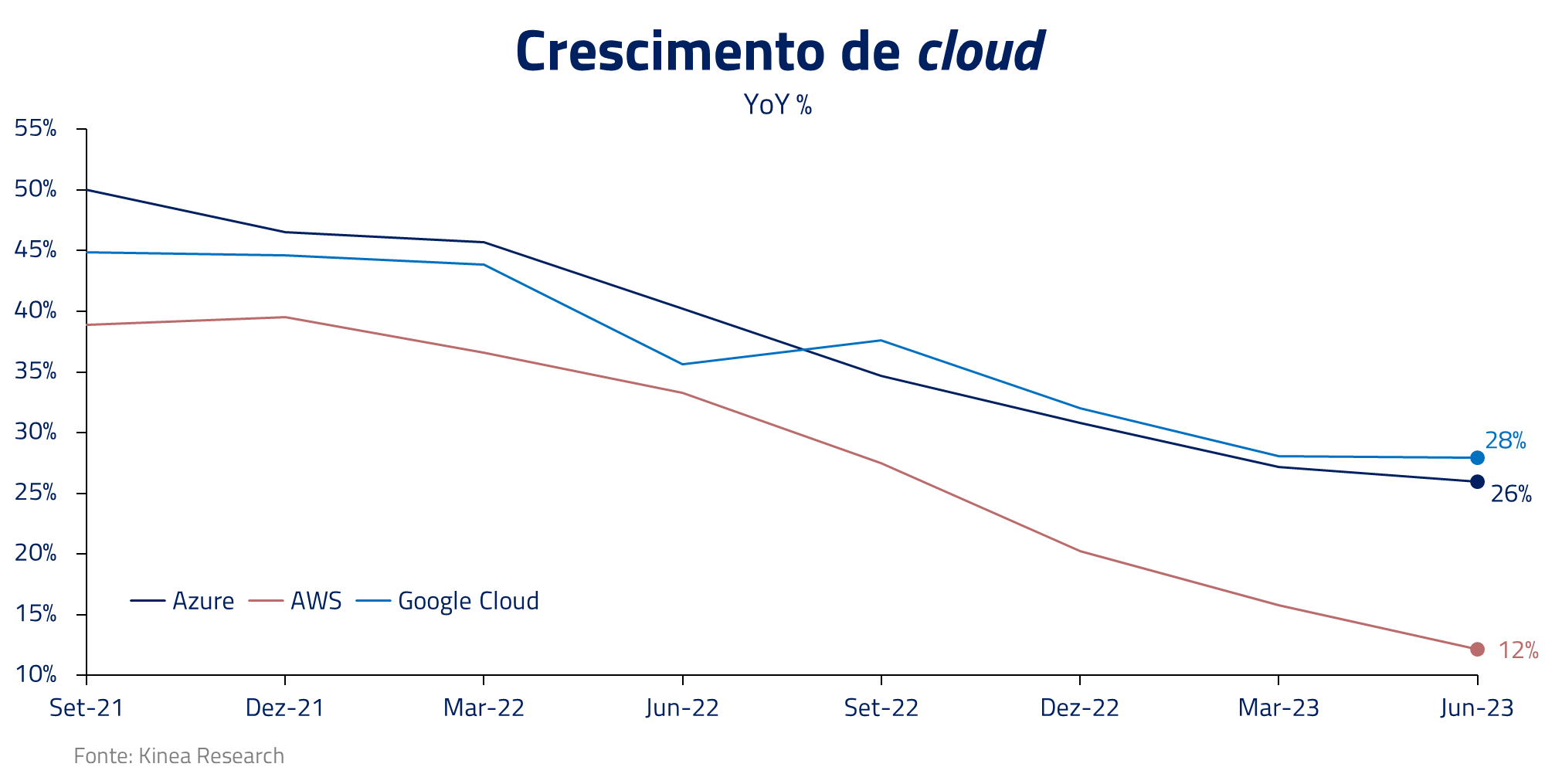

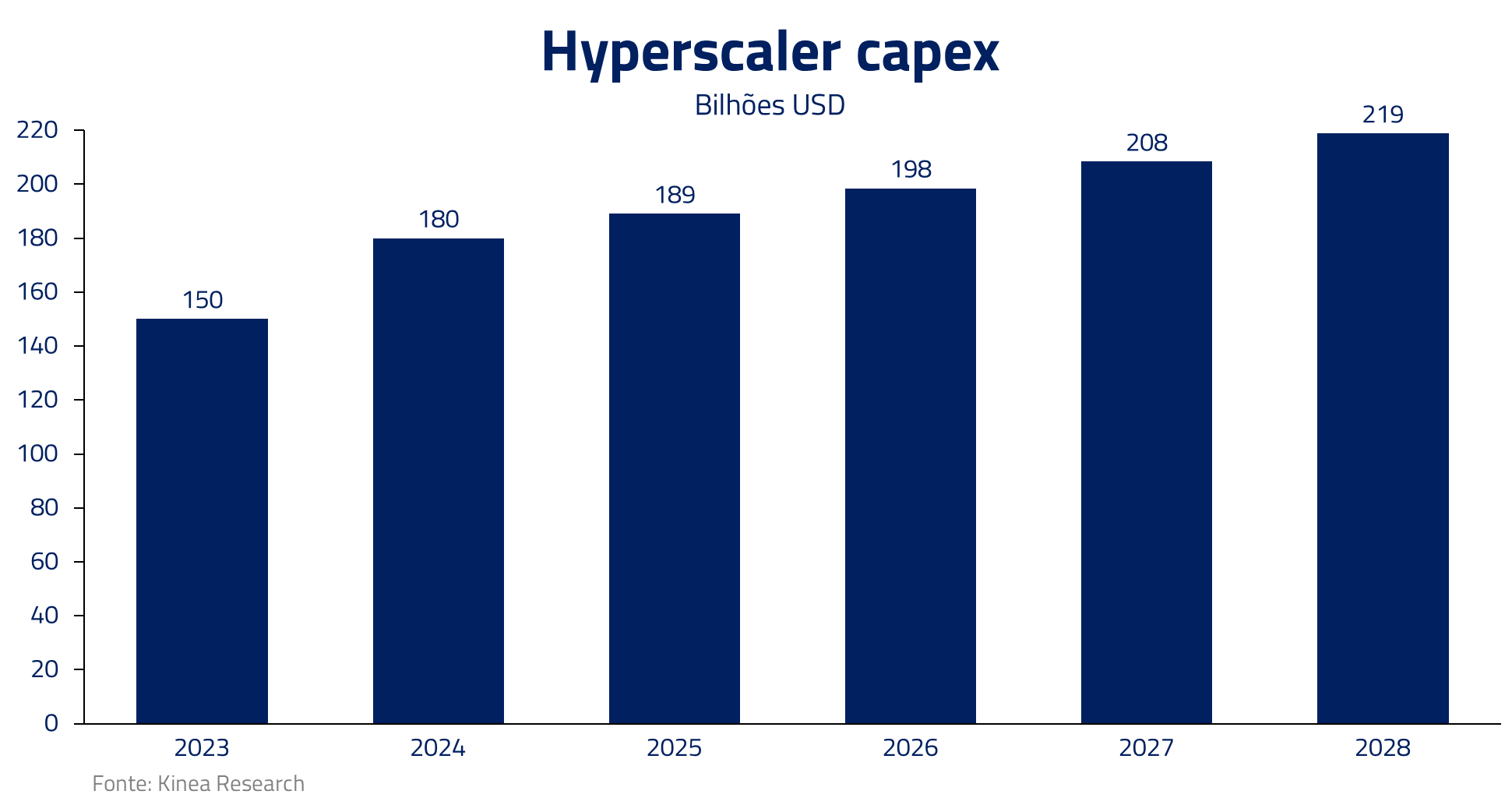

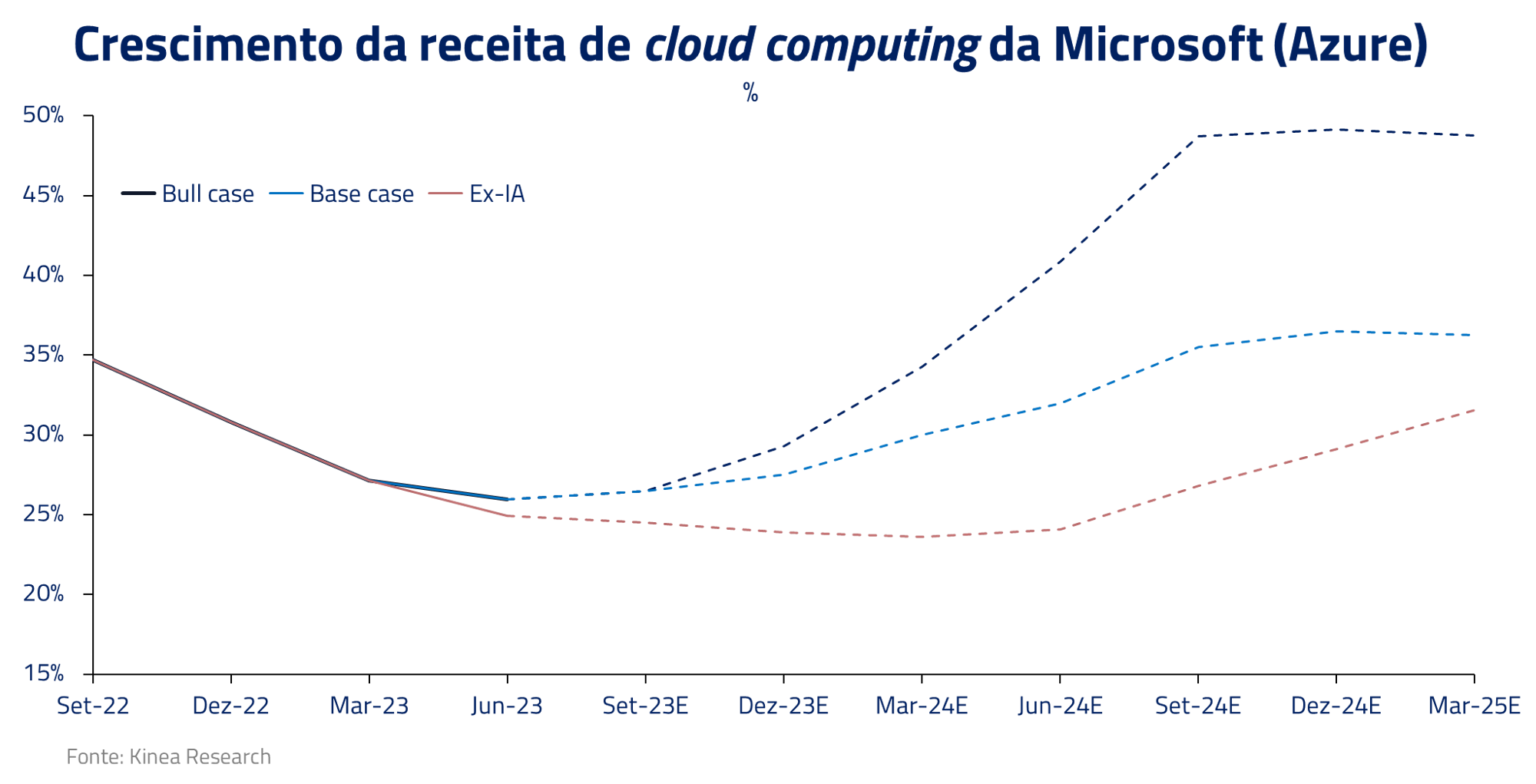

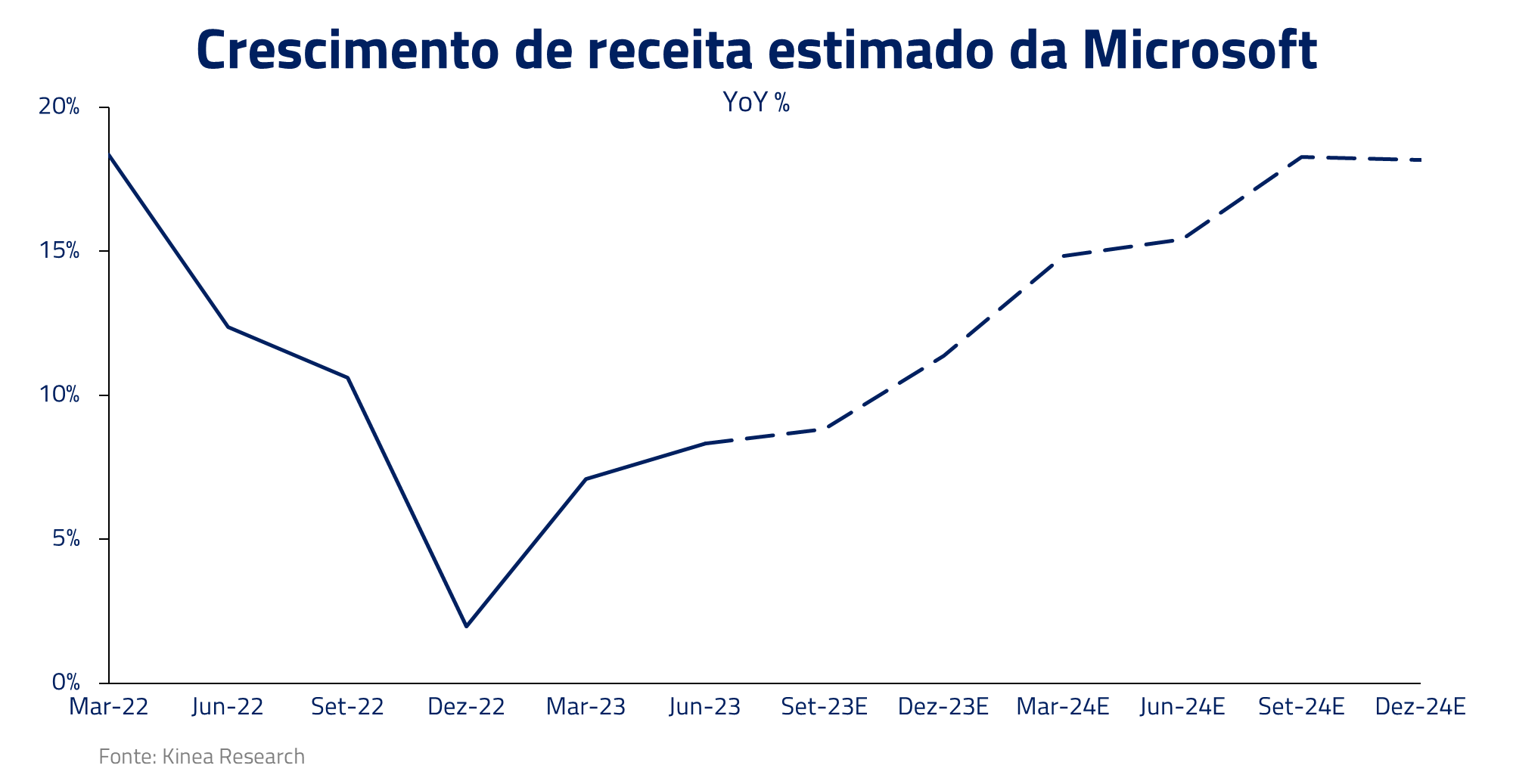

O rápido desenvolvimento dos modelos de IA deve trazer consigo uma reaceleração da demanda por computação na nuvem.

Após forte crescimento ao longo da última década, o mercado de cloud computing havia mostrado seus primeiros sinais de desaceleração pelas líderes AWS (Amazon) e Azure (Microsoft) ao longo de 2022 e 23.

Parte dessa desaceleração foi causada por um período de acomodação desse mercado após forte crescimento: clientes que consumiram rapidamente grande quantidade de serviços na nuvem passaram por um período de otimização de recursos.

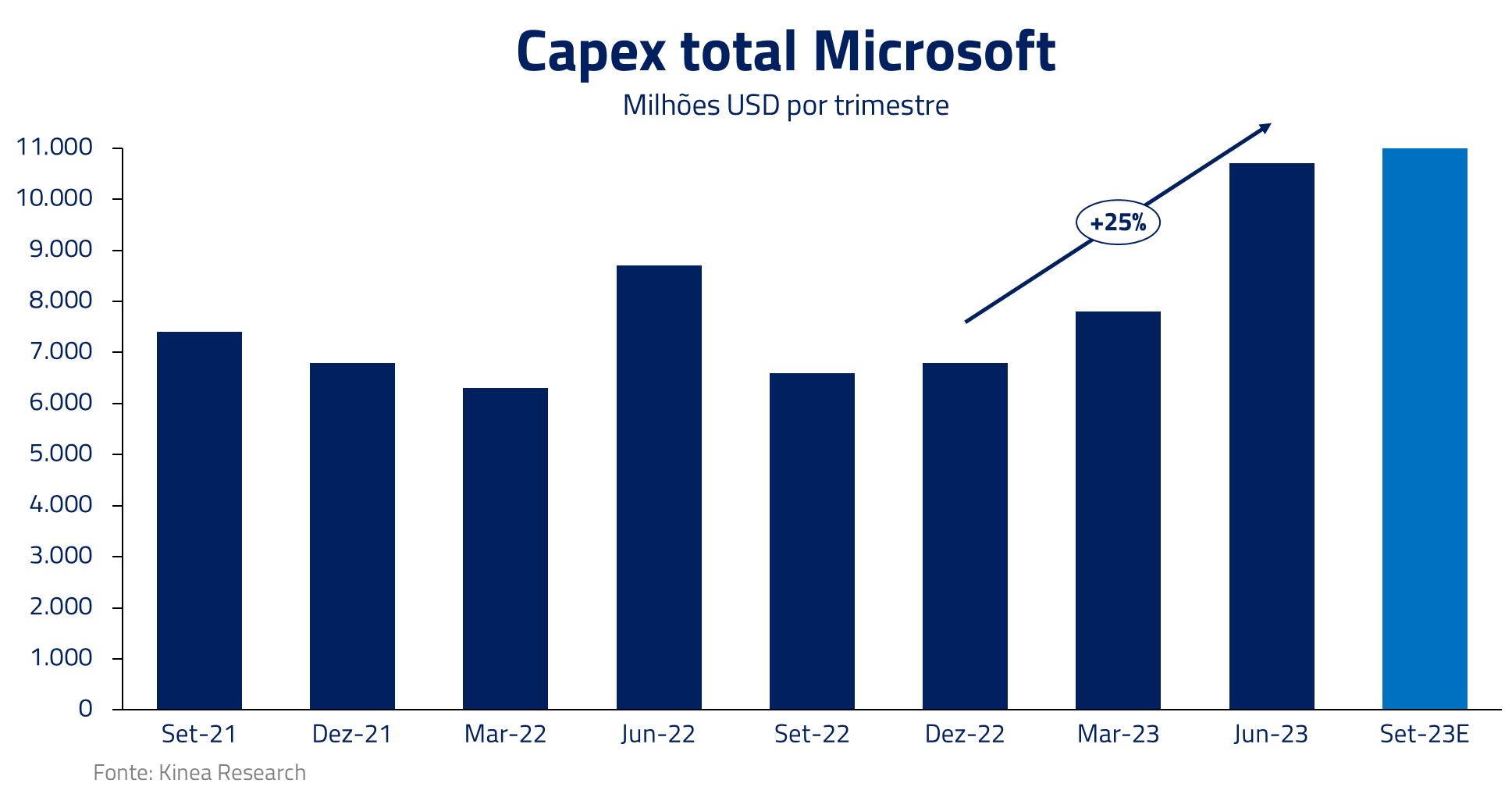

Entretanto, IA pode trazer uma nova fase de aceleração para esse mercado. O Capex da Microsoft para esse trimestre foi elevado para $10.7 bilhões, um crescimento substancial quando comparado com o trimestre anterior de $7.8 bilhões.

Estimamos que essa elevação de cerca de 3 bilhões de Capex se refira, praticamente em sua totalidade, as compras de novos processadores GPUs e equipamentos para ampliação da capacidade de processamento em nuvem para empresas de IA.

Embora seja mais difícil visualizar essa tendência na AWS (Amazon), em virtude dos números de Capex não serem separados da operação de e-commerce, imaginamos que uma tendência similar esteja ocorrendo na empresa.

Logicamente, o crescimento de Capex está sendo realizado na expectativa de crescimento substancial de receita por venda de capacidade de cloud computing para treinamento e inferência. Em nossos modelos, imaginamos que a oportunidade de IA pode acelerar o crescimento da Azure para patamares acima de 30% ao ano e mantemos posições compradas em Microsoft e Amazon.

Aplicações e seus potenciais de receita. O caso do Microsoft co-pilot

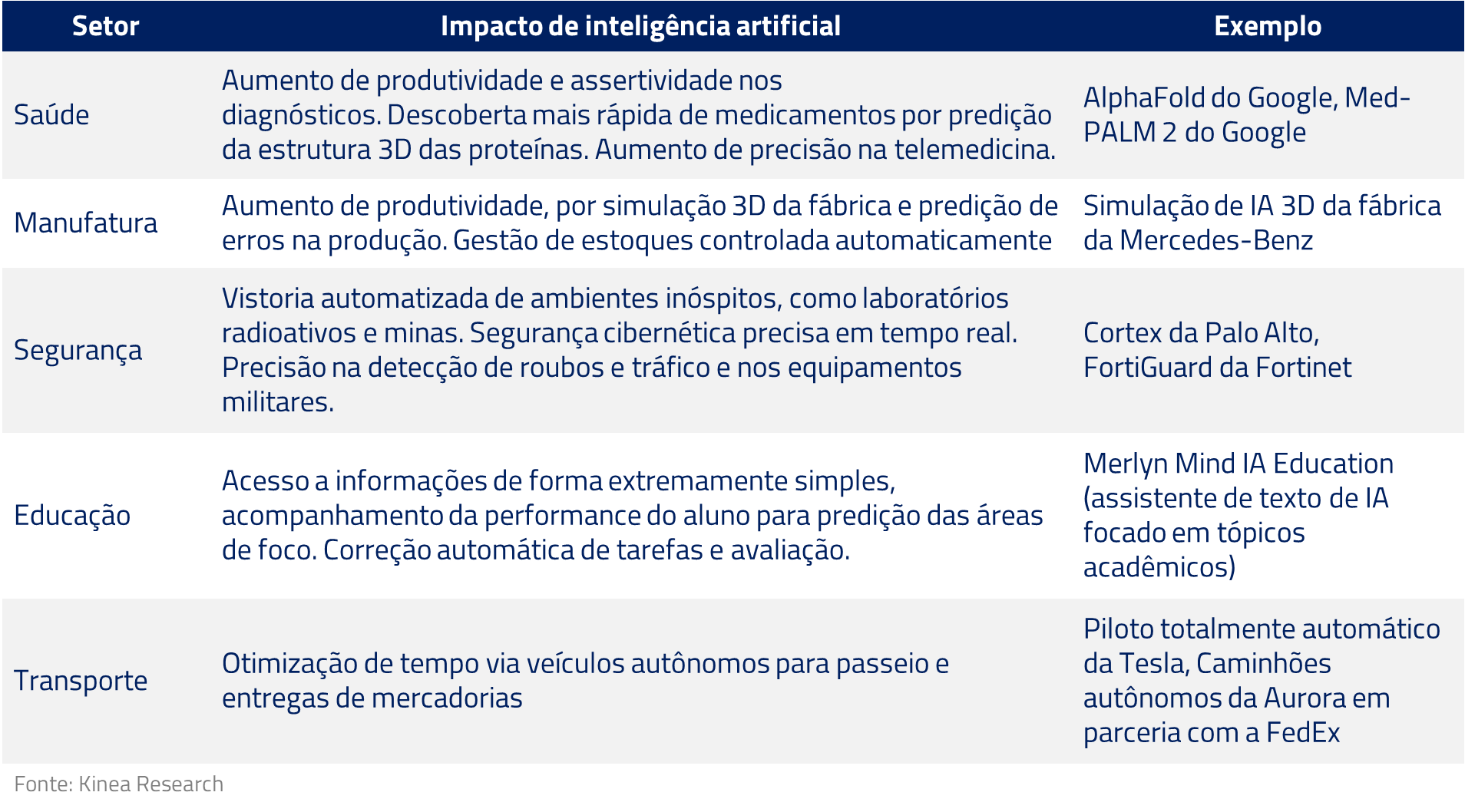

Nenhum CEO pode se dar ao luxo de não responder ao seu conselho como a empresa tem investido no campo da inteligência artificial. Empresas hoje se encontram sob risco de obsolescência tecnológica, qualquer que seja seu campo de atuação, caso não respondam de modo adequado a essa nova tecnologia.

No campo das aplicações práticas dessa tecnologia, alguns produtos já emergem como potenciais vencedores e podem vir a transformar a receita de empresas no setor.

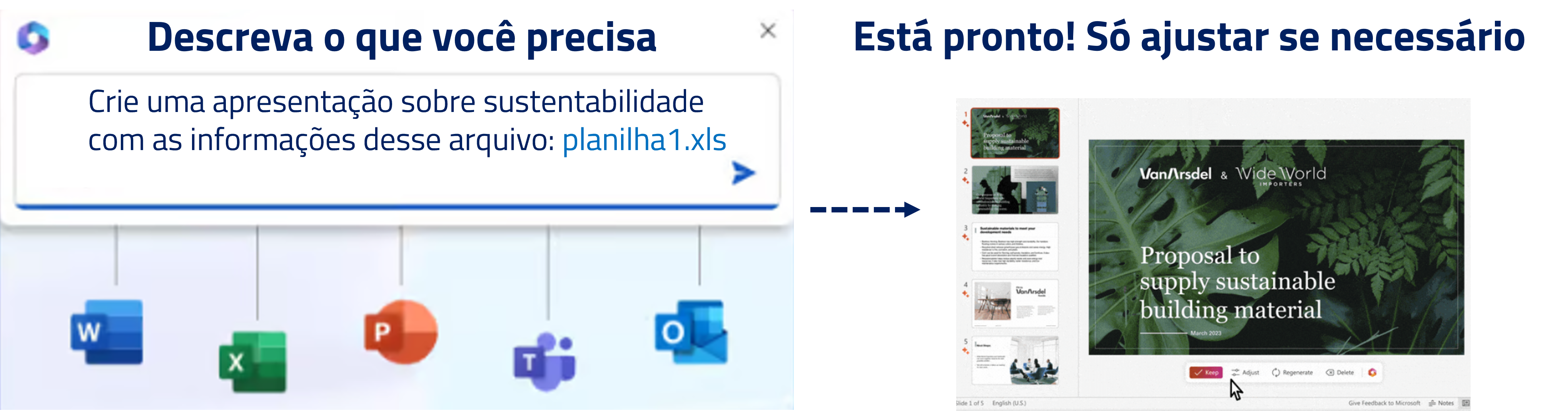

Nesse Insights, decidimos focar no case do Microsoft Co-Pilot, a nova aplicação de inteligência artificial da Microsoft para o Office 365 (Word, Excel, Outlook, PowerPoint).

Nesse Insights, decidimos focar no case do Microsoft Co-Pilot, a nova aplicação de inteligência artificial da Microsoft para o Office 365 (Word, Excel, Outlook, PowerPoint).

Caso ainda não tenha visto essa nova aplicação, recomendamos clicar aqui e assistir ao vídeo em que a empresa apresenta esse novo produto. Em linhas gerais, ele consiste em usar o ferramental já conhecido do ChatGPT nas ferramentas da Microsoft, permitindo rápida construção de planilhas e texto via ferramental de IA, com elevado ganho de produtividade.

Hoje a Microsoft cobra uma anuidade média de $100 para o Office 365 comercial. Recentemente, a empresa sugeriu que a ferramenta de IA, esperada para ser lançada em 2024, possa ser vendida por $30 por mês, gerando ganhos substanciais de receita para a empresa mesmo após considerarmos o típico desconto nesse serviço.

A empresa vem testando essa ferramenta em um projeto piloto com mais de 600 empresas ao redor do planeta. A faixa sugerida de preços, em linha com o plano plus do ChatGPT (que hoje é de $20 por mês), nos parece indicar que o produto está sendo bem recebido pelas empresas e, como consequência, a Microsoft se sente confortável em guiar um saudável aumento na tabela de preços.

Em virtude do potencial impacto em receita, combinado com possível reaceleração do business de cloud, hoje mantemos uma posição comprada em Microsoft nos nossos fundos.

***

Em um mundo de infinitas possibilidades de aplicações no campo da inteligência artificial, decidimos, no momento, focar os esforços de nosso portfólio nas empresas indispensáveis para a infraestrutura desse mercado, seja no campo da fabricação e desenho dos processadores (TSMC e Nvidia) ou no campo da infraestrutura necessária para treinamento e inferência dos modelos (cloud computing: Microsoft e Amazon).

Reconhecemos que, brevemente, novas oportunidades se mostrarão presentes no campo das aplicações, como no caso do Co-Pilot da Microsoft, e estamos ativamente pesquisando esse mercado na tentativa de identificar essas futuras oportunidades. Certamente, voltaremos ao tema em um terceiro insight sobre o setor.

***

E como termina a história de Alan Turing e o Enigma? Após desvendar o código, uma das decisões mais difíceis foi como fazer uso da informação: se usada em demasiado, os nazistas desconfiariam que seu código foi quebrado, e poderiam mudar a criptografia. Uma difícil decisão teve que ser tomada: o uso seletivo da informação, mesmo ao custo de vidas durante a guerra.

A história do Enigma nos leva a outro paralelo de decisão a de quando informações devem ser utilizadas: em uma famosa história, o tenista Andre Agassi descobriu que Boris Becker movia a língua de acordo com a direção que iria sacar.

Agassi mencionou que a decisão mais difícil foi a de quando utilizar a informação, porque do contrário Becker descobriria que ele sabia de algo. Se você gostou dessa história, nosso Kafé com Kinea desse mês, com Fernando Meligeni, explora a relação entre o mundo esportivo do tênis e o investimento.

Receba insights da Kinea exclusivos diretamente no seu e-mail.

Assine nossa newsletter.

Ao assinar a newsletter, você aceita receber comunicados da Kinea e concorda com nossa Política de Privacidade.

A história de Turing teve um desfecho triste após a guerra. De modo similar a Oppenheimer, Turing foi perseguido, tendo sido vítima de preconceito. Infelizmente, de forma diferente de Oppenheimer, não chegou a viver para ser condecorado por seus feitos que salvaram a vidas de milhões na Segunda Guerra Mundial.

***

Estamos sempre à disposição de nossos clientes e parceiros

Kinea Investimentos

Saiba onde investir nos fundos Kinea

Entre em contato e saiba como adquirir um de nossos fundos.