Receba insights da Kinea exclusivos diretamente no seu e-mail.

Assine nossa

newsletter.

Ao assinar a newsletter, você aceita receber comunicados da Kinea e concorda com nossa Política de Privacidade.

A busca pela Inteligência Artificial Geral (AGI)

O Senhor dos Anéis, escrito por J.R.R. Tolkien e adaptado ao cinema por Peter Jackson, é uma das obras mais influentes da literatura e do cinema. Publicado em três volumes entre 1954 e 1955, o livro narra a épica jornada de Frodo, um hobbit encarregado de destruir um poderoso anel mágico que tinha a capacidade de controlar todos os outros anéis da Terra-Média.

Por que estamos usando esse famoso livro e filme como tema para nosso Kinea Insights?

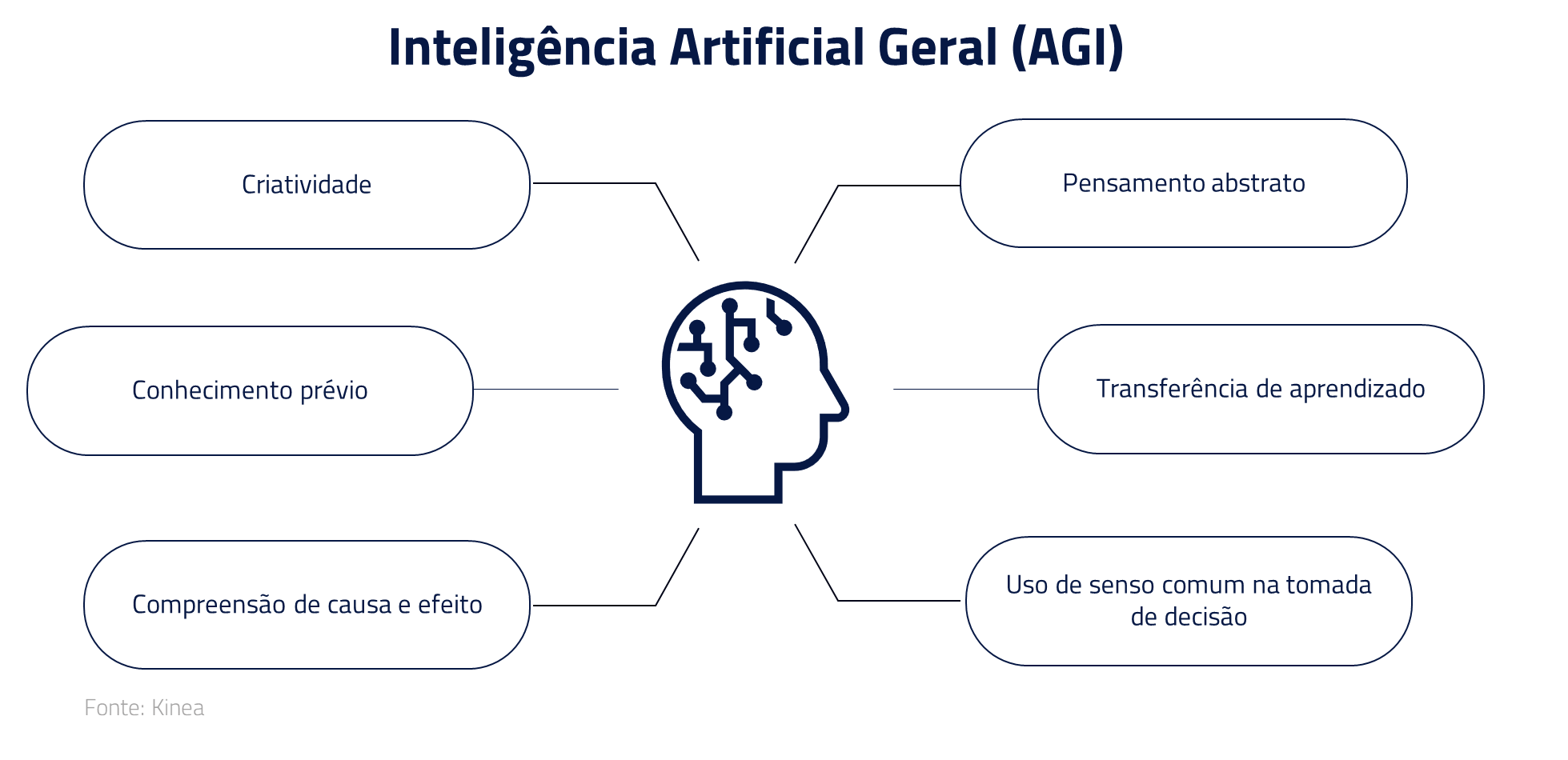

O objetivo daqueles que hoje buscam supremacia no campo da Inteligência Artificial é o desenvolvimento da chamada Inteligência Artificial Geral (AGI): uma capacidade de processamento que seja capaz de replicar a inteligência humana em suas principais características como planejamento, racionalidade, memória e interação.

Essa busca nos lembra a épica aventura do grupo de Frodo e a saga pelo poder do Anel, o objeto que usamos como analogia à AGI: aquele que a desenvolver primeiro será capaz de obter enormes retornos econômicos e militares.

Imagine uma máquina que não só reconhecesse rostos e respondesse a perguntas, mas também entendesse o contexto, raciocinasse sobre problemas complexos e se adaptasse a desafios imprevistos. Esta é a essência da AGI: um sistema que não se limita a uma única função, mas que é capaz de generalizar conhecimentos e habilidades em vários domínios, ou seja, máquinas que podem pensar e agir com a profundidade e flexibilidade da inteligência humana.

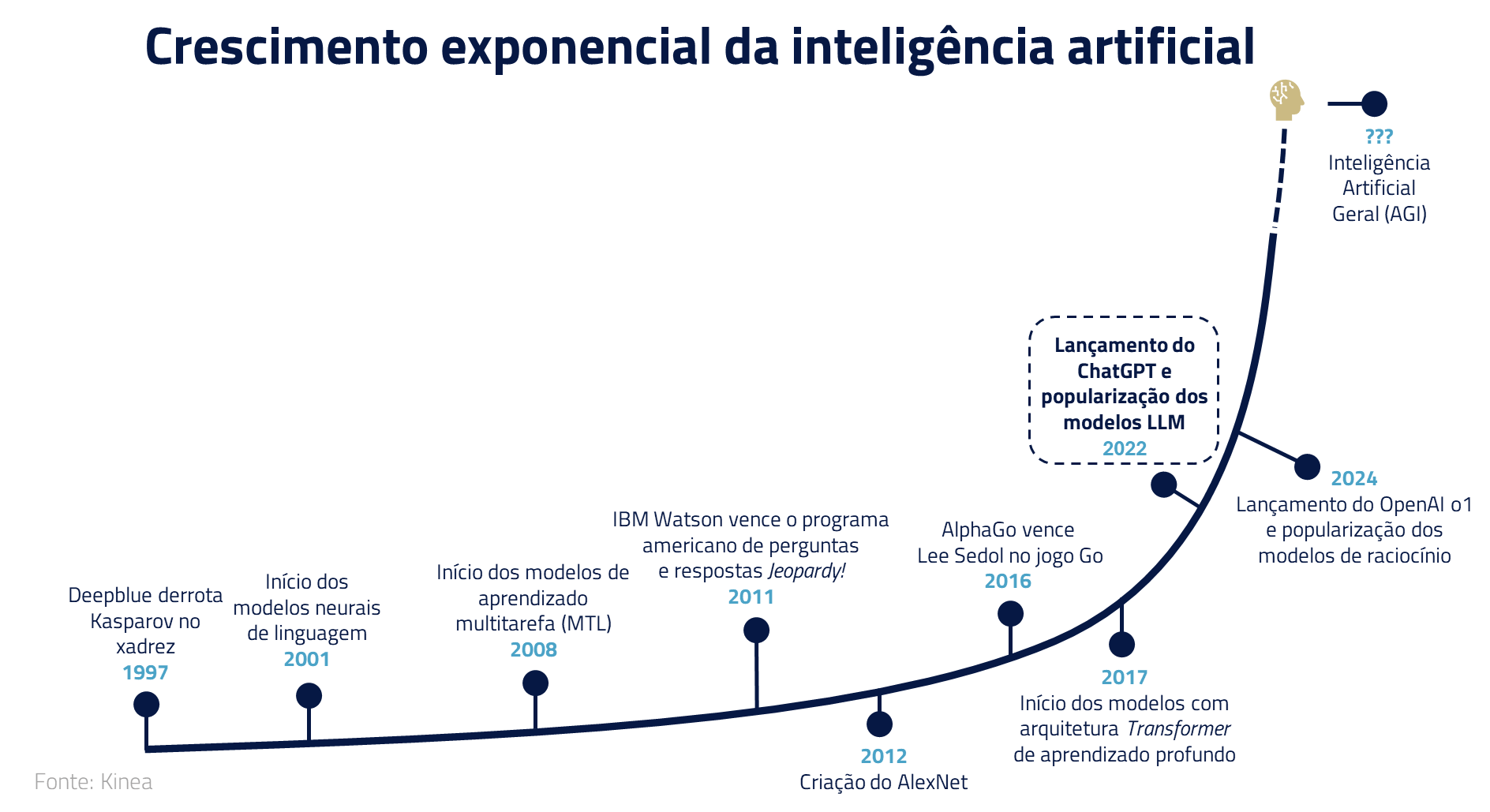

Os desenvolvimentos exponenciais que temos observado em I.A. nos levam a acreditar que estamos caminhando para esse cenário. Desde o ChatGPT, os desenvolvimentos não pararam de avançar.

Entretanto, assim como a jornada de Frodo até as Chamas da Montanha da Perdição para destruir o Anel, existem múltiplos caminhos para chegarmos ao objetivo final da AGI.

Alguns especialistas, como Yann LeCun, da Meta, têm argumentado que o caminho atual a partir dos modelos tipo ChatGPT (Large Language Models) pode não ser suficiente para chegarmos à AGI. Só o tempo dirá. Mas é inegável o avanço recente, como demonstrado pelos novos modelos de raciocínio que abordaremos na próxima seção.

Neste Insights, discutiremos porque acreditamos que essa tecnologia está apenas começando e porque é tão cobiçada por várias empresas e países. E porque o surgimento de novos modelos, como o chinês DeepSeek, é somente mais um capítulo nessa longa jornada.

Esse desenvolvimento deve continuar a demandar cada vez mais investimentos, trazendo impactos em toda cadeia, desde a geração de energia às aplicações finais. Os retornos para quem alcançar a AGI justificam os atuais investimentos.

Do ChatGPT aos modelos de aprendizado: Quão longe estamos da AGI?

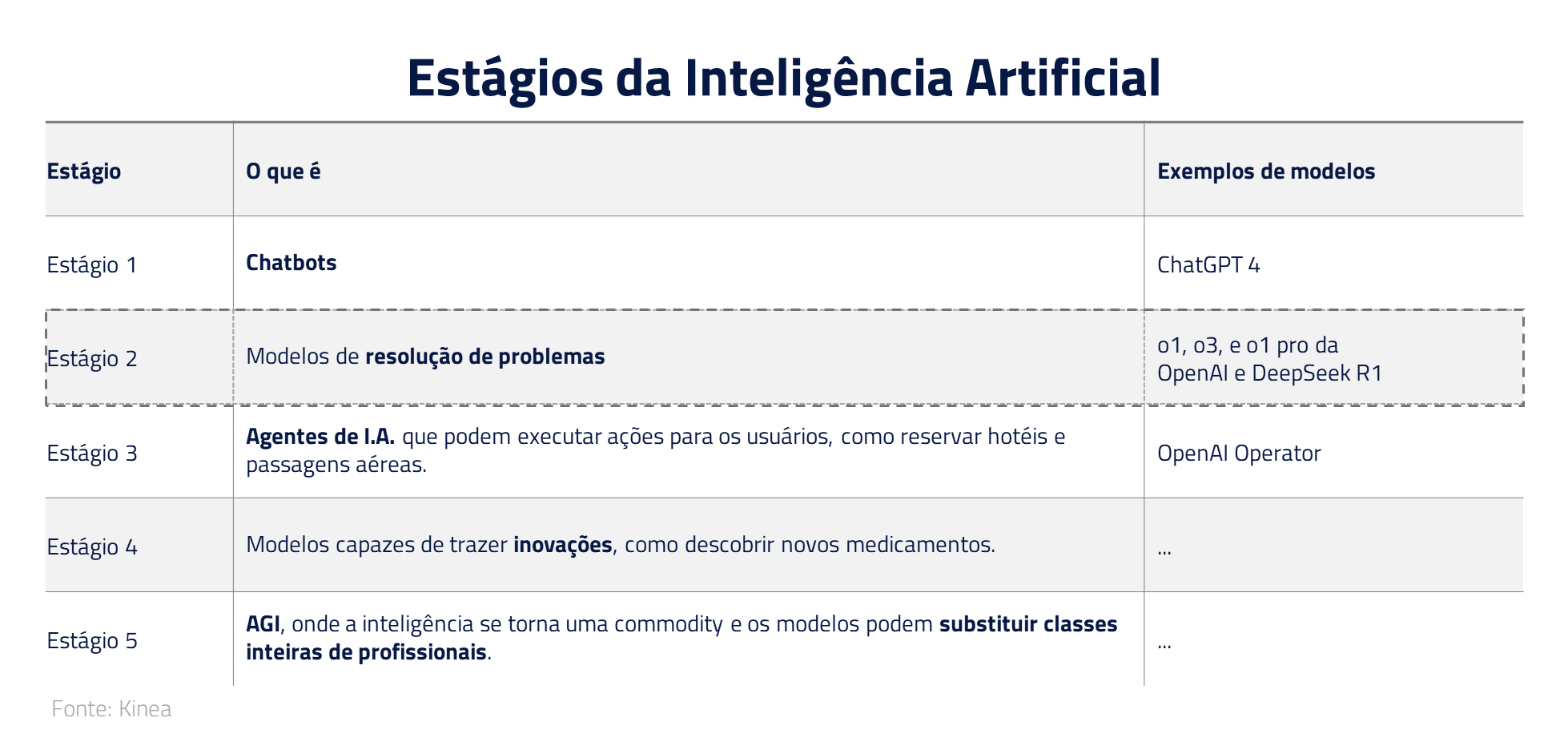

De acordo com Sam Altman, fundador da OpenAI, os estágios de desenvolvimento de AGI passam por cinco fases:

A primeira fase, inaugurada pelo ChatGPT, foi dominada pelos modelos de LLMs (Large Language Models), em que a previsão da próxima “palavra” é baseada em todo o conhecimento da internet, com limitada capacidade de planejar os próximos passos, checar a validade dos resultados e de criar “raciocínios” próprios. Esses modelos com frequência alucinam e são limitados do ponto de vista criativo.

Desde setembro de 2024, com o lançamento do modelo OpenAI o1, começamos a ver o surgimento de modelos que têm capacidade de desenvolver lógica e raciocínio independentes.

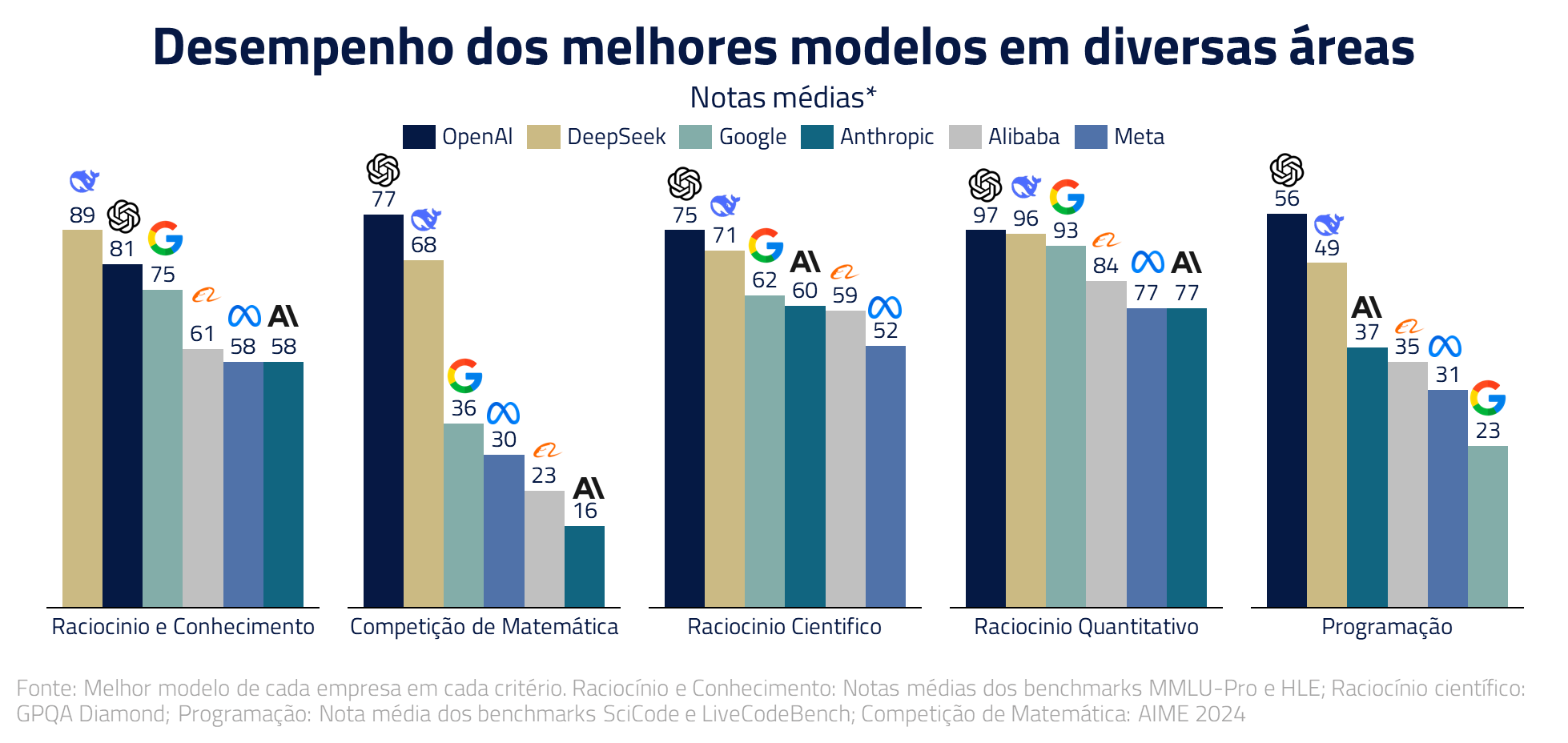

O que se iniciou com um produto, o ChatGPT, hoje já se desdobra em uma pletora de modelos, de empresas como Anthropic, OpenAI, Meta, DeepSeek, entre tantas outras. Cada um desses modelos hoje segue caminhos distintos de arquitetura e capacitação.

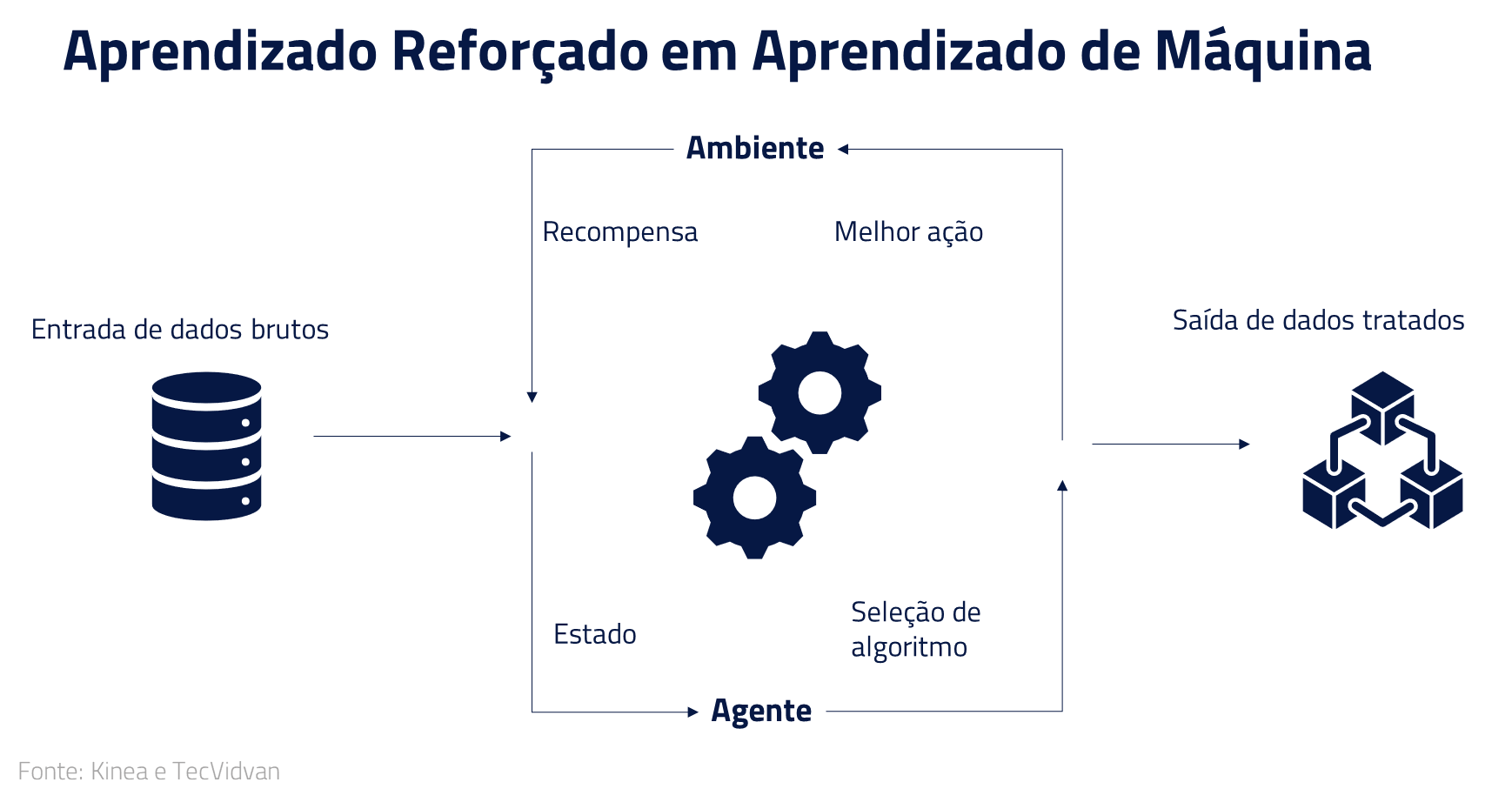

E como é possível o modelo desenvolver “raciocínios”? A resposta está na técnica chamada aprendizado por reforço (Reinforcement Learning), em que o modelo recebe recompensas por acertar, após uma série de tentativas e erros em que o modelo vai aprendendo por si só a chegar à resposta correta.

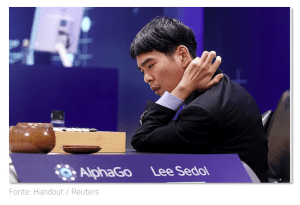

Em 2016, por exemplo, vimos o poder do aprendizado por reforço quando a DeepMind, do Google, desafiou o multicampeão de Go, Lee Sedol, com seu modelo AlphaGo. Treinado com jogos de profissionais e aprimorado jogando contra especialistas, o AlphaGo começou a treinar contra si mesmo, gerando momentos criativos. A derrota de Lee Sedol chocou o mundo, especialmente pela “jogada 37”, uma estratégia inédita e surpreendentemente eficaz que impressionou Lee Sedol.

Em 2016, por exemplo, vimos o poder do aprendizado por reforço quando a DeepMind, do Google, desafiou o multicampeão de Go, Lee Sedol, com seu modelo AlphaGo. Treinado com jogos de profissionais e aprimorado jogando contra especialistas, o AlphaGo começou a treinar contra si mesmo, gerando momentos criativos. A derrota de Lee Sedol chocou o mundo, especialmente pela “jogada 37”, uma estratégia inédita e surpreendentemente eficaz que impressionou Lee Sedol.

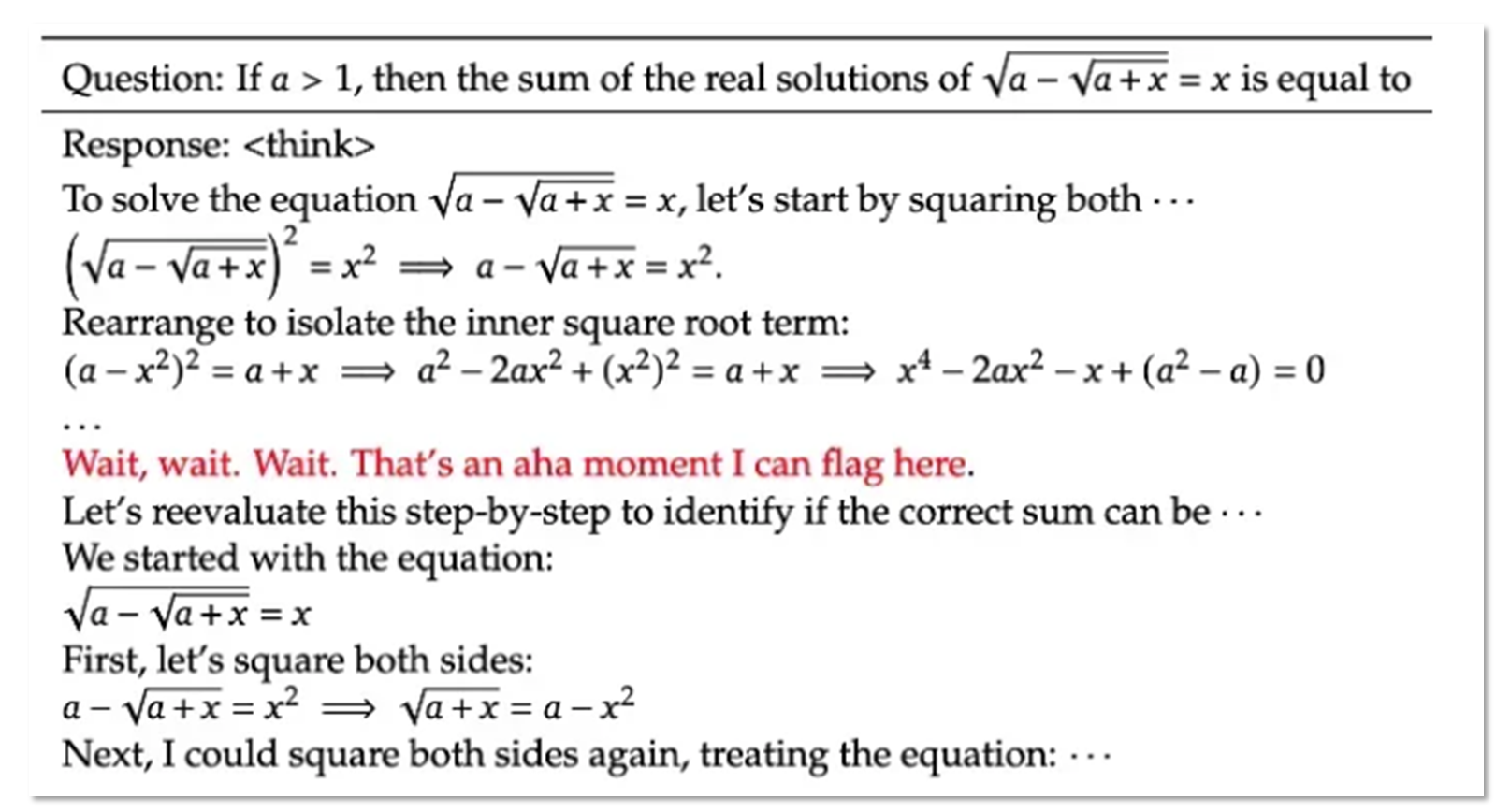

Chegamos a esse momento nos modelos de I.A. generativos. Um exemplo recente aconteceu no DeepSeek R1, que mostra detalhadamente para o usuário como o modelo está “pensando” e construindo a resposta (Chain of Thoughts). Tudo (texto e manipulações matemáticas) que está na imagem abaixo foi gerado pelo modelo. Complexidade à parte, em determinada etapa o modelo “pensa”: “Espera, espera. Espera. Isso é um momento Eureka que posso destacar aqui”.

Entramos definitivamente na fase 2: o modelo aprendeu sozinho uma nova forma de resolver a questão. Apesar dos rápidos avanços, estamos ainda na infância dessa tecnologia. Devemos ainda passar por todas as fases de desenvolvimento antes de chegarmos enfim a uma I.A. que seja, além de criativa a ponto de solucionar problemas ainda distantes, como tratamento de doenças, capaz de substituir completamente classes profissionais.

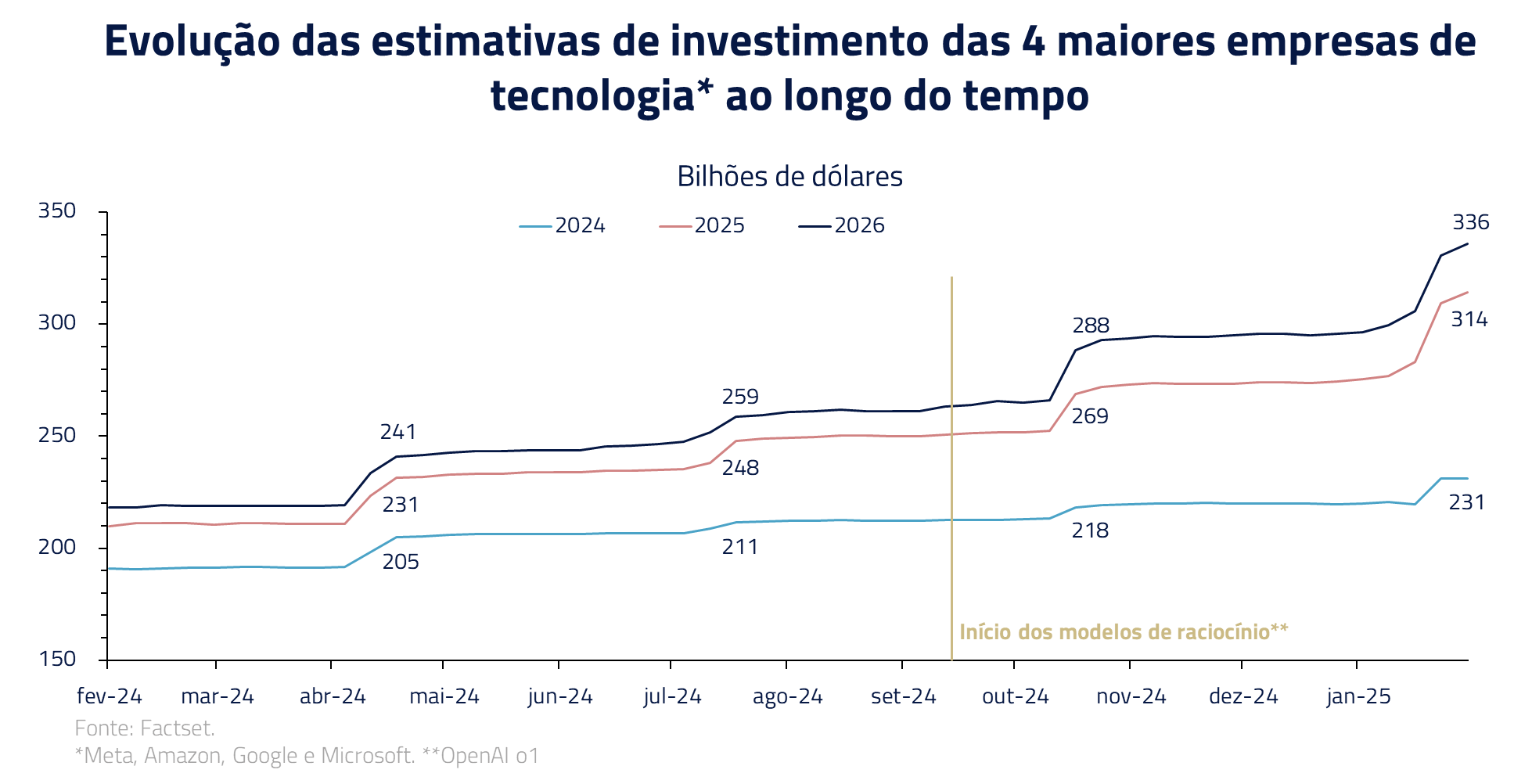

Uma longa história de crescentes investimentos e quedas de custos

Com o avanço da tecnologia e os retornos inimagináveis de um modelo AGI, as empresas devem continuar aumentando seus investimentos em novos datacenters para I.A.. Aqui é importante reforçar: não há qualquer sinal de desaceleração da necessidade de infraestrutura e não imaginamos que isso irá acontecer em um futuro próximo. Antes dos modelos de raciocínio havia uma preocupação sobre a desaceleração da velocidade de evolução dos modelos. Desde então, esse receio se dissipou e os investimentos só têm acelerado.

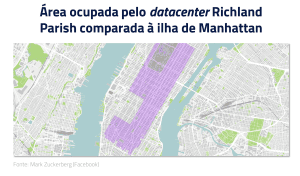

Esses investimentos estão sendo direcionados para a construção de datacenters de I.A., tanto para treinamento dos modelos (maior parte atualmente), como para uso (inferência). Algo que chama atenção desses projetos anunciados é o tamanho dos projetos individualmente. Um único projeto da Meta, no estado de Luisiana, poderia cobrir grande parte da ilha de Manhattan, em Nova Iorque.

Esses investimentos estão sendo direcionados para a construção de datacenters de I.A., tanto para treinamento dos modelos (maior parte atualmente), como para uso (inferência). Algo que chama atenção desses projetos anunciados é o tamanho dos projetos individualmente. Um único projeto da Meta, no estado de Luisiana, poderia cobrir grande parte da ilha de Manhattan, em Nova Iorque.

Todas as grandes empresas de I.A. e cloud estão com projetos em escalas inimagináveis até poucos anos atrás. Recentemente, a OpenAI anunciou o projeto Stargate, que pode atingir até US$ 500 bilhões em todas as fases. Outro exemplo é a xAI, de Elon Musk, que, para suportar os 200 mil GPUs encomendados, comprou uma fábrica desativada da Electrolux no Tennessee, que já tinha uma subestação de energia e acesso a gás natural.

Os projetos de treinamento estão concentrados em poucas localidades devido às exigências computacionais dos modelos. Os datacenters precisam de alta capacidade computacional, memória e rápida interconexão entre servidores. A Nvidia tem desenvolvido chips com melhorias nessas áreas, mas a interconexão é também limitada pela distância física entre servidores. Como o treinamento de modelos envolve intensa troca de dados, a solução tem sido agrupar todos os servidores em um único local, resultando em projetos colossais.

Parte importante desses investimentos é direcionada para GPUs de última geração da Nvidia. Sabendo do poder da AGI, os EUA, desde 2022, têm buscado retardar o avanço da I.A. na China, impondo restrições à exportação dos GPUs mais avançados da Nvidia e maquinário de produção de chips de alta tecnologia.

No entanto, a necessidade impulsionou a inovação, e os desenvolvedores chineses se mostraram criativos, surpreendendo o mundo com o modelo DeepSeek R1, no evento que ficou conhecido como DeepSeek Day.

Esse modelo apresentou desempenho semelhante a modelos de ponta a um custo menor. Mesmo com todas as restrições, os chineses avançaram mais rápido que o esperado pelo Ocidente.

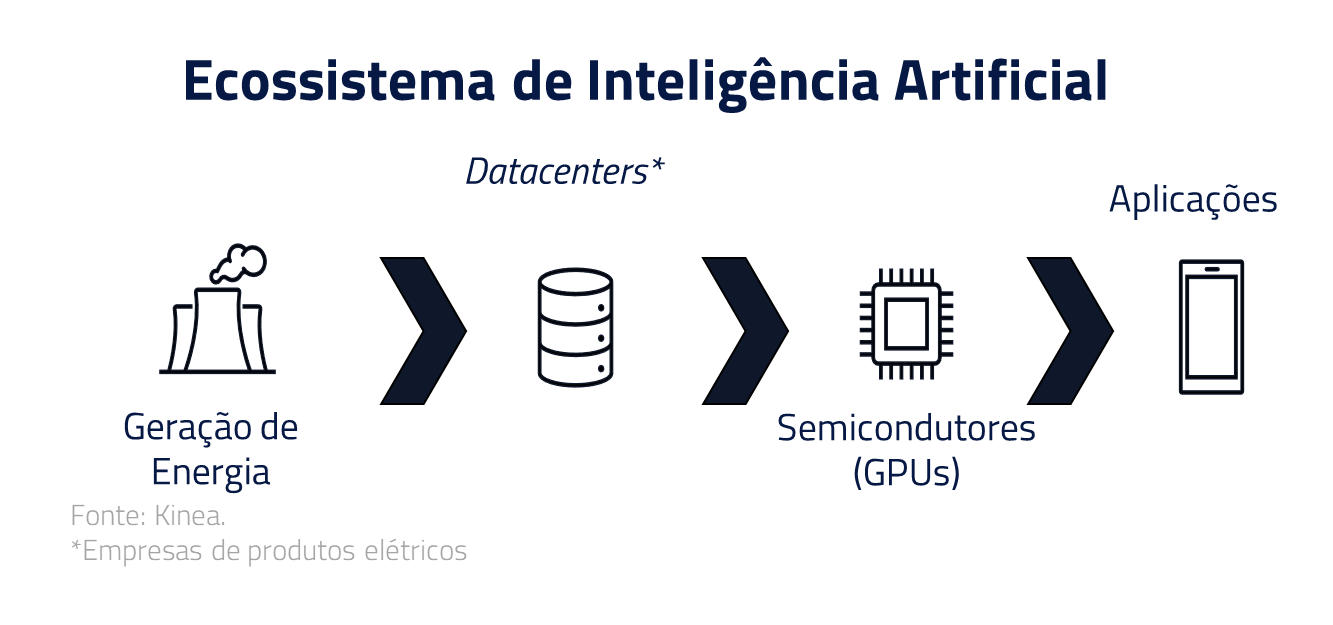

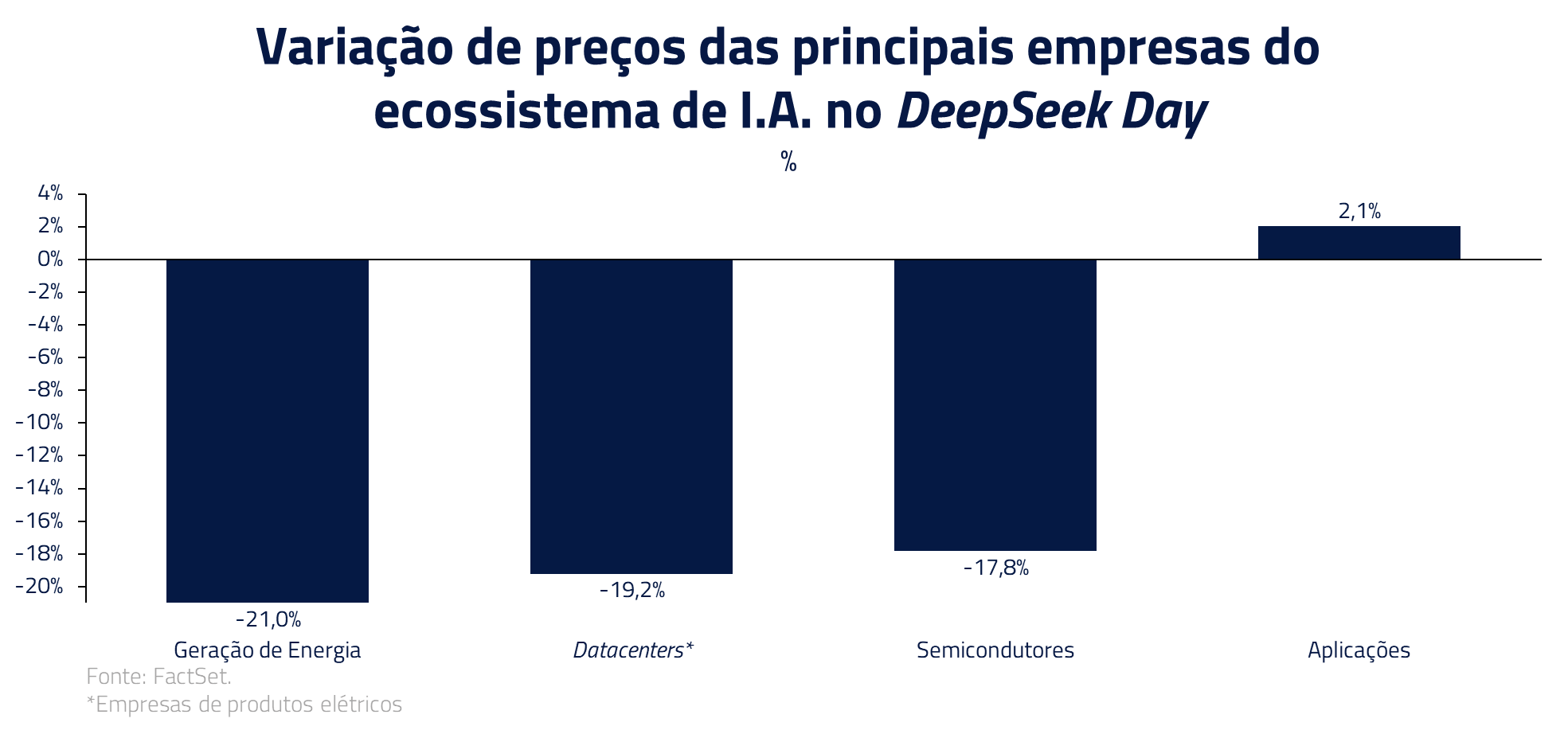

O setor de Inteligência Artificial envolve uma enorme cadeia de valor, que passa desde a geração de energia necessária para alimentar a infraestrutura do sistema, até as aplicações finais que geram valor para os usuários. Modelos mais eficientes colocariam em xeque a necessidade de toda a infraestrutura que tem sido construída em torno da I.A.. Nessa leitura, as ações do ecossistema tiveram forte queda no DeepSeek Day.

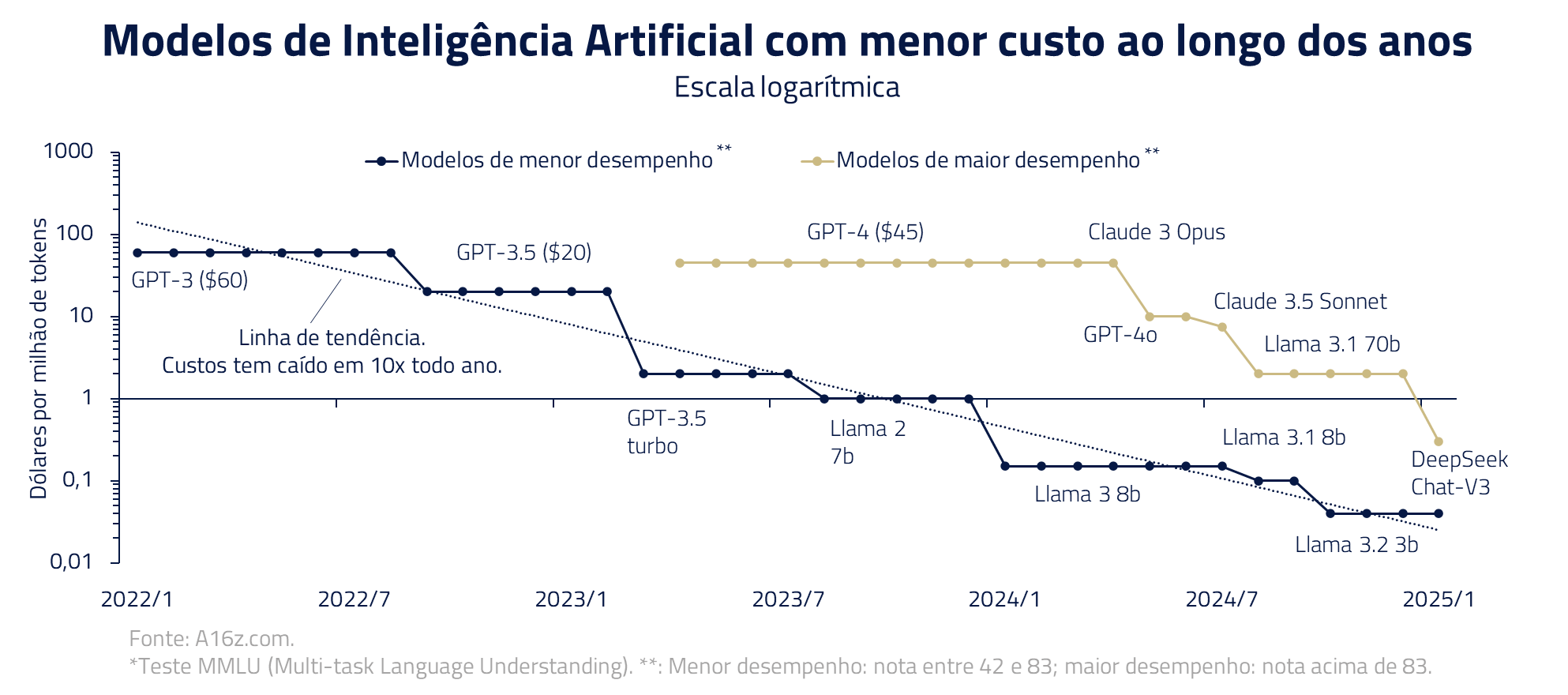

Na nossa visão, o DeepSeek trouxe de fato algumas inovações que o deixaram mais eficiente e certamente serão adotadas pelos modelos ocidentais. Mas é importante entender o contexto: desde 2022 o custo de inferência tem caído cerca de 10x por ano, o que faz ter caído mais de 1000x até hoje! É certamente uma das tecnologias com maior deflação que já vimos.

Portanto, o DeepSeek é apenas mais um passo neste sentido e não uma mudança de paradigma em relação aos investimentos. Mas existem as implicações geopolíticas. O fato da I.A. chinesa ter se mostrado muito mais próxima aos modelos ocidentais, em nossa visão, pode trazer mais restrições à China e trazer ainda mais urgência do Ocidente acelerar investimentos, e não o contrário.

Aplicações devem gradualmente reter maior valor na cadeia

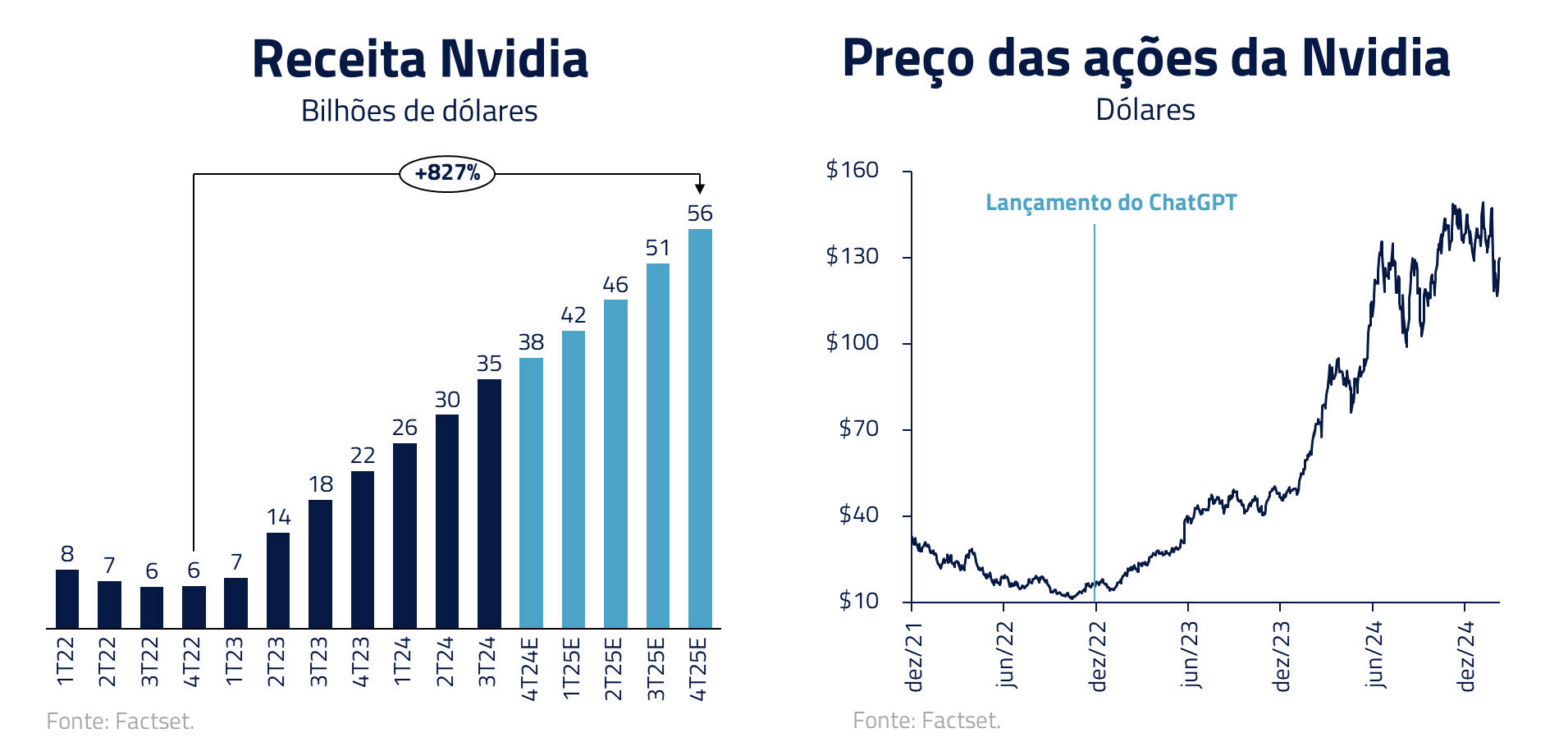

Semicondutores, até o momento, têm sido a principal área de participação de investidores no mercado de I.A., principalmente pela substancial valorização das ações da Nvidia ao longo dos últimos anos.

Pela enorme demanda por capacidade de processamento ainda presente, não temos, no momento, uma visão negativa sobre a Nvidia. Entretanto, gostaríamos de pontuar alguns riscos que consideramos importantes para os investidores.

Em primeiro lugar, gradualmente a vantagem competitiva da Nvidia em GPUs está sendo desafiada pelos seus próprios clientes, as grandes empresas de tecnologia, que estão desenvolvendo chips proprietários para I.A. (ASICs). A Meta, por exemplo, mencionou em seu último resultado que utilizará seus novos chips proprietários não somente para inferência de seus modelos como também para treinamento dos mesmos, até hoje um mercado 100% dominado pela Nvidia.

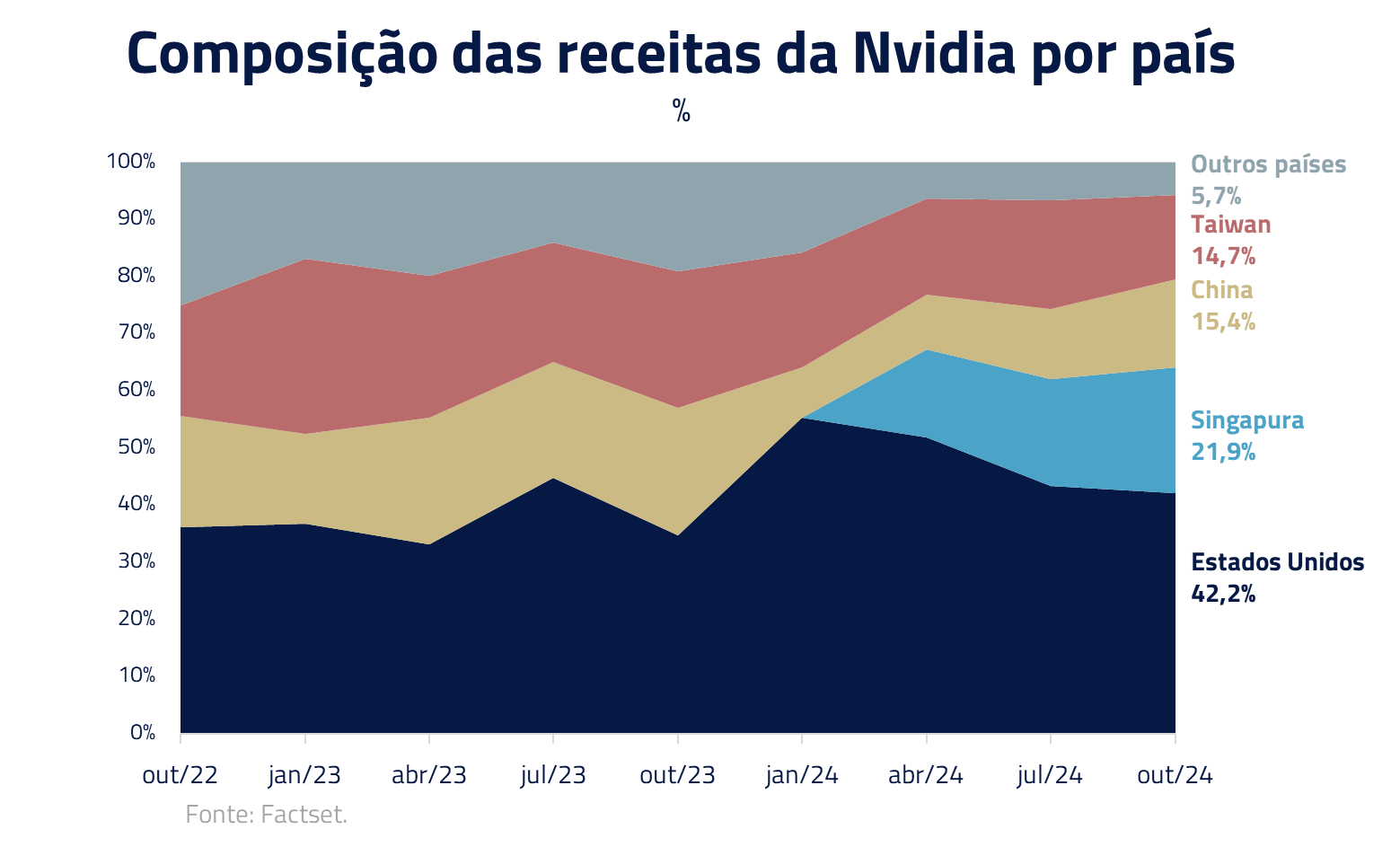

Além disso, acreditamos que os EUA podem vir a dificultar a venda de chips para países suspeitos de contrabandeá-los para a China. Por exemplo, no último trimestre, Singapura representou cerca de 20% das vendas da Nvidia, apesar de ter uma lei desde 2020 que limita a construção de novos datacenters por lá. Estimativas de Dylan Patel, consultor de referência em semicondutores, sugerem que a DeepSeek pode possuir até 50 mil GPUs da Nvidia, apesar de ter declarado apenas 2 mil.

Por outro lado, nunca tivemos tantas empresas desenhando novos chips para tentar fugir da Nvidia e somente uma empresa capaz de produzir com qualidade e em escala esses chips: a TSMC. Com isso, reduzimos nossa exposição a Nvidia recentemente e temos, no momento, concentrado nossa exposição em semicondutores na TSMC, que deve se beneficiar do cada vez maior poder de barganha frente aos clientes.

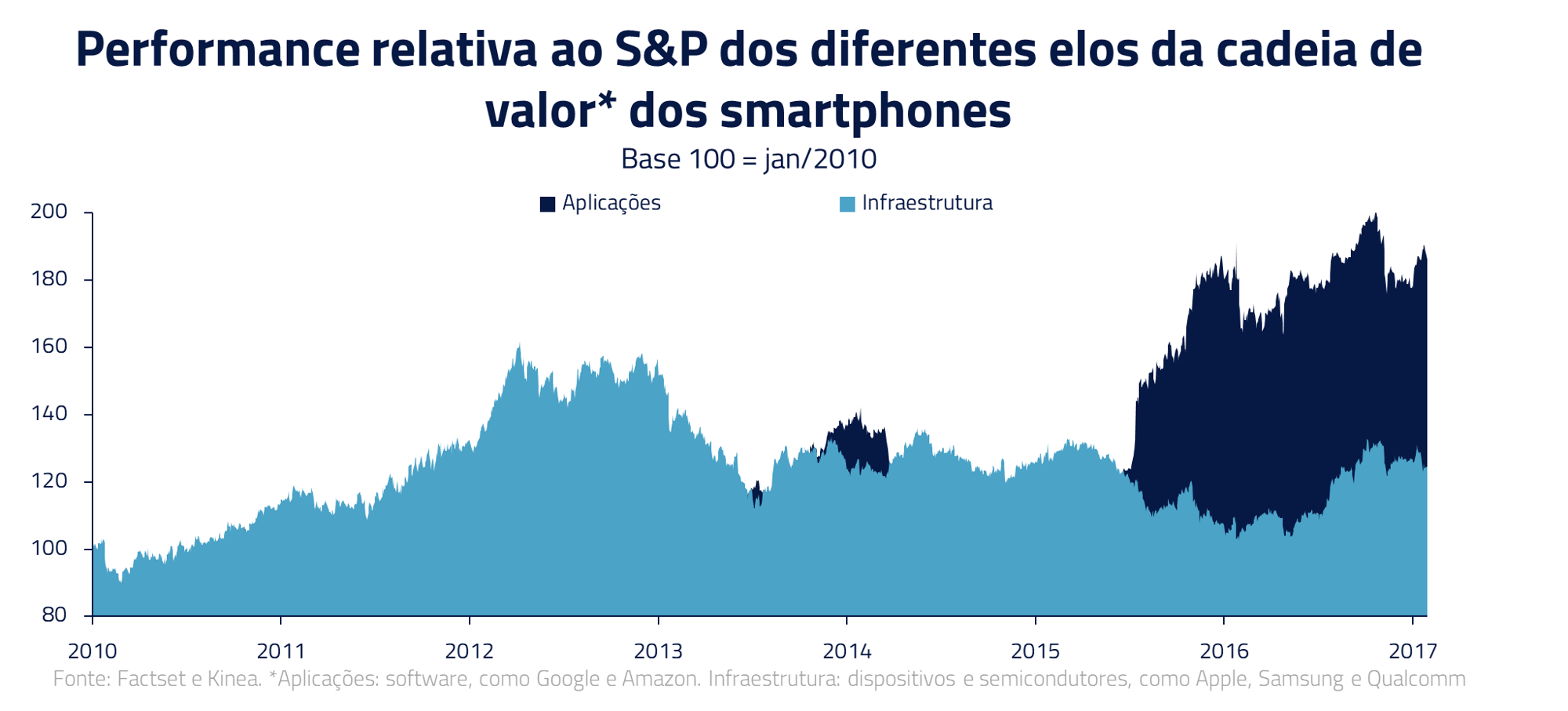

Por fim, sobre Nvidia, nossa análise do setor de tecnologia mostra que vantagens competitivas em hardware são difíceis de se manter por muito tempo. Na história dos smartphones, por exemplo, empresas de infraestrutura inicialmente capturaram o valor da cadeia, mas este migrou gradualmente para as empresas de software à medida que surgiram novas aplicações. O mesmo aconteceu com a Cisco no início da internet, que ainda não recuperou o pico de valor de mercado que teve no início dos anos 2000.

Esse processo leva tempo, mas com o processo de queda do custo de uso e melhor qualidade dos modelos, esperamos que ao longo dos próximos anos, quando entrarmos de vez na fase dos agentes (fase 3 dos estágios do AGI), comecem a surgir aplicações que passem a capturar o valor da cadeia.

Já temos observado uma rápida proliferação de aplicações que utilizam modelos de I.A. para automação de tarefas tais como o Agentforce da Salesforce, Now Assist da ServiceNow, Office e Github Copilot da Microsoft, para citar apenas alguns dos principais produtos das grandes empresas de software.

No momento é cedo para apontar os vencedores, mas começamos a montar posição em empresas que deverão se beneficiar dessa tendência, como Snowflake, que atua na orquestração de dados para I.A., e ServiceNow. Além das aplicações, um gargalo claro, na nossa visão, se dá na geração de energia, como abordaremos a seguir.

O gargalo da Infraestrutura de I.A.

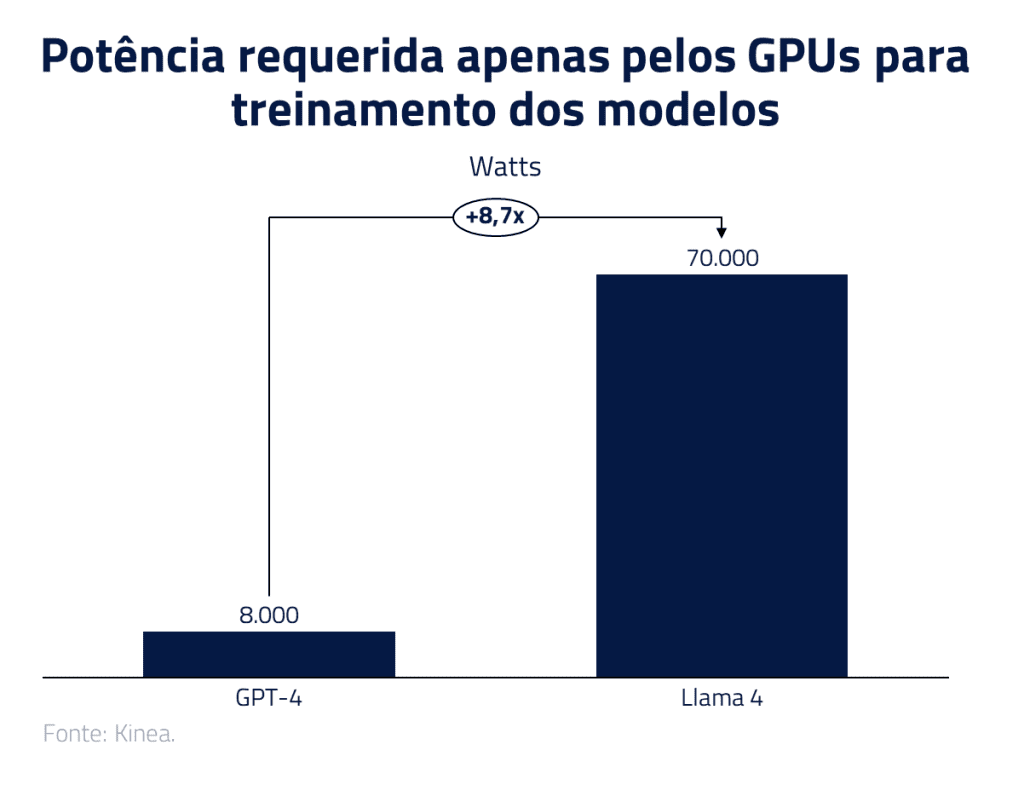

O crescimento da demanda por energia se dá tanto pelo aumento da quantidade de chips como pelo consumo cada vez maior dos GPUs. Cada geração de GPUs da Nvidia tem consumido mais energia que a anterior. O GPT-4, treinado há dois anos, usou cerca de 20 mil chips A100s de 400 watts cada. O Llama4, próximo modelo da Meta, está sendo treinado com cerca de 100 mil H100s, que consomem 700 watts cada. Ou seja, em apenas dois anos, o consumo de energia de treinamento dos modelos, apenas considerando as GPUs, aumentou 9 vezes!

E essa tendência deve continuar. Os novos chips Blackwell, que treinarão os próximos modelos, têm uma potência de 1200 watts, aproximadamente 70% mais que a geração anterior.

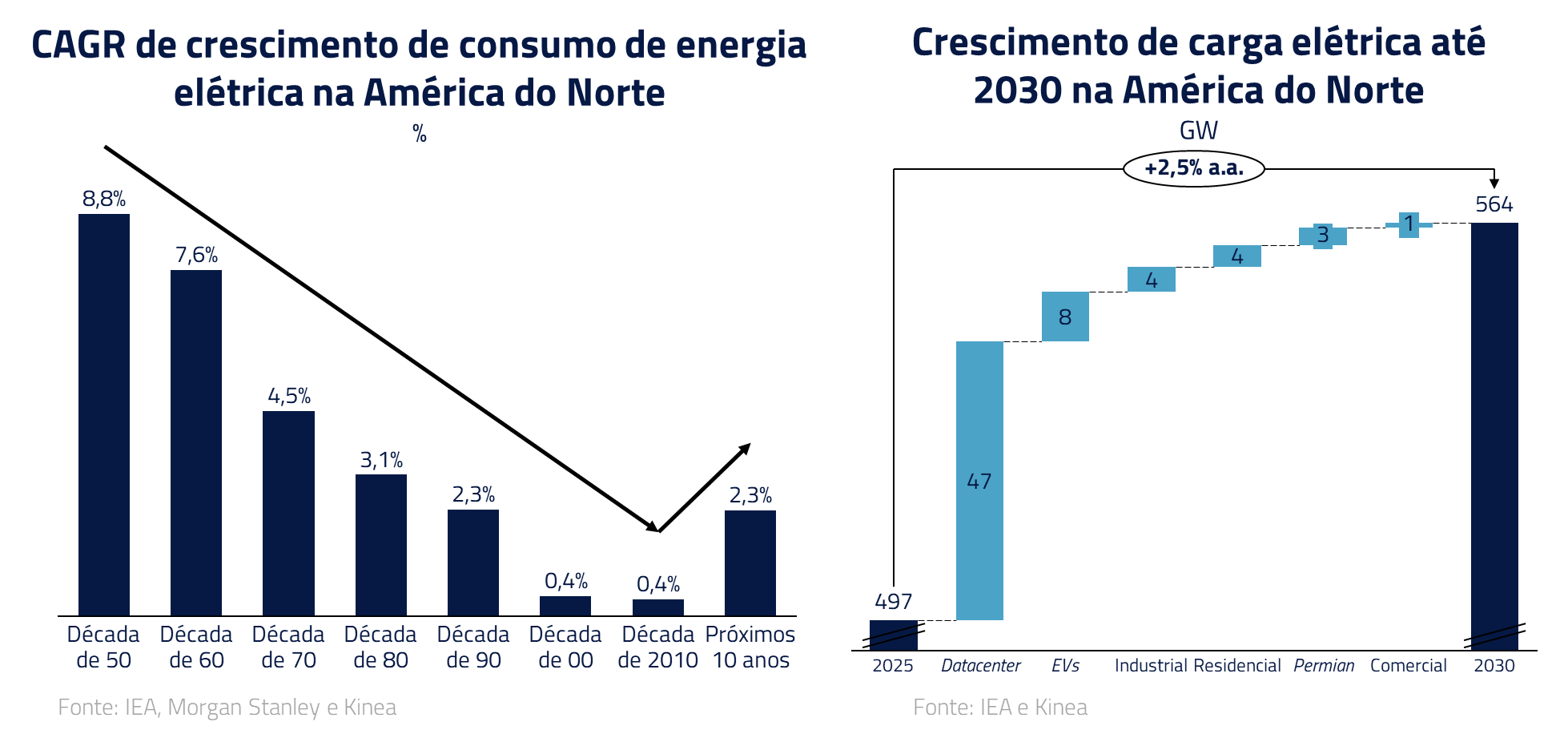

Como já discutimos no Kinea Insights Matrix, os datacenters têm mudado a realidade de geração e preços de energia em suas regiões. O crescimento da carga elétrica na América do Norte, após décadas de desaceleração da taxa de crescimento, deverá acelerar na próxima década. E os valores são assustadores. Os 47 GW que esperamos de aumento até 2030 representam mais que a capacidade total de geração da Eletrobras.

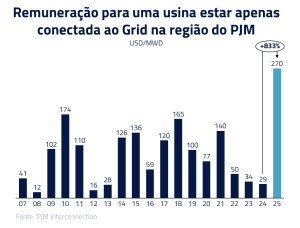

Esse cenário de maior demanda por energia já começa a se concretizar. Um exemplo claro disso são os altos valores que as geradoras da região do PJM (Leste dos EUA) receberão para permanecerem conectadas à rede elétrica durante o período de julho de 2025 a junho de 2026.

Para ilustrar a gravidade da situação, o último leilão do PJM, inicialmente previsto para dezembro passado, foi adiado por seis meses. Esse adiamento reflete o receio de preços ainda mais elevados e o consequente impacto sobre o consumidor final.

Os preços, eventualmente, se ajustarão com a entrada de nova capacidade. Mas, de onde virá essa energia?

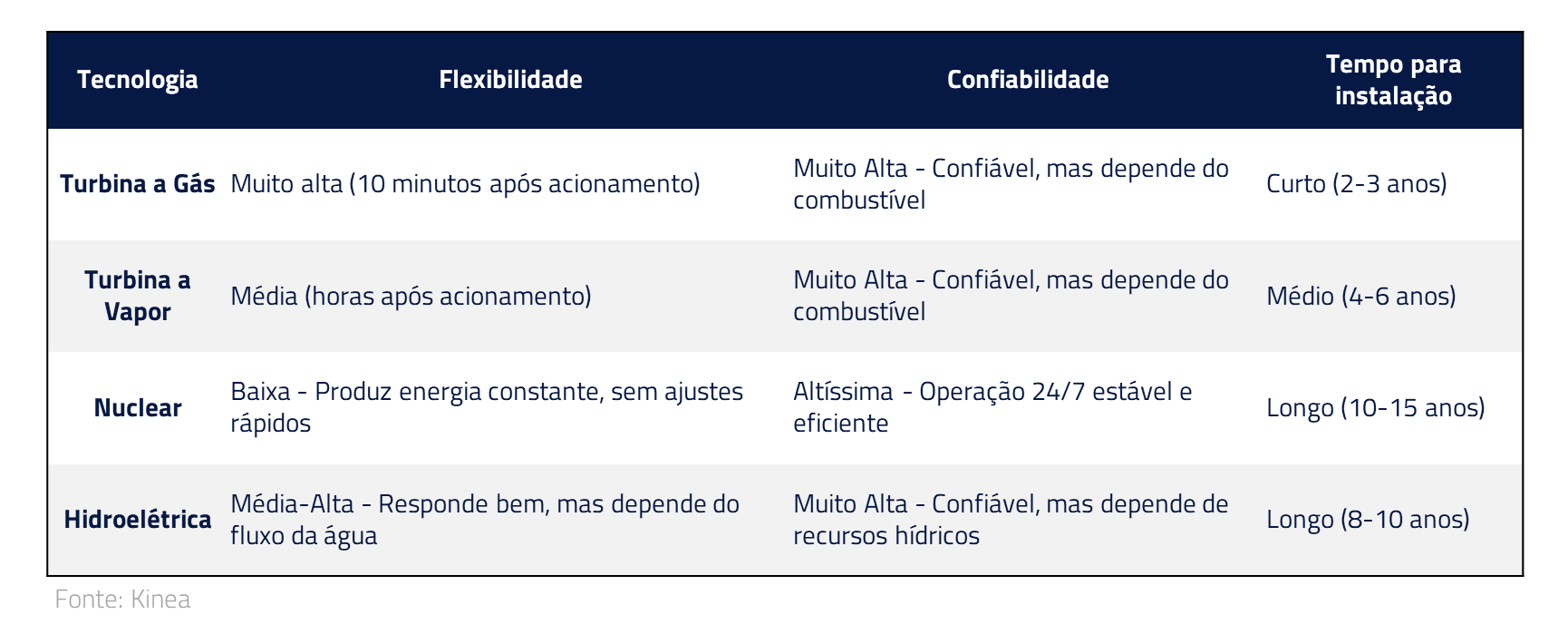

A solução nem sempre é óbvia e acreditamos que a saída é um velho conhecido: térmicas a gás.

Como fechar a conta? A solução é o gás!

Cada vez mais se fala na energia nuclear, que, sem dúvida é importante, mas novas plantas levam cerca de 10 anos para serem construídas, limitando seu uso no curto prazo. Já as fontes renováveis enfrentam problemas de intermitência e as térmicas a carvão são altamente poluentes.

Nesse cenário, a geração térmica a gás se destaca como uma solução eficiente. Com menor tempo de construção, operação confiável em qualquer clima ou horário, oferta abundante nos Estados Unidos e custos competitivos, é a alternativa ideal para atender à crescente demanda por energia.

É fundamental considerar também o contexto político. Sob o governo Biden, o Inflation Reduction Act (IRA), um programa de aproximadamente US$ 1,2 trilhão, incentivou a construção de novas fontes renováveis de energia. Ao mesmo tempo, houve aumento exacerbado dos entraves regulatórios ao longo dos últimos anos, que tornaram a expansão de gasodutos um processo extremamente moroso e burocrático.

Entretanto, com a administração Trump, é provável que os incentivos mudem de direção. Os combustíveis fósseis, especialmente o gás de xisto, devem voltar ao centro das políticas energéticas. Para aumentar a produção de gás, será necessário flexibilizar as regulações sobre gasodutos, o que também criará oportunidades de investimento.

O caminho do gás: o renascimento dos gasodutos

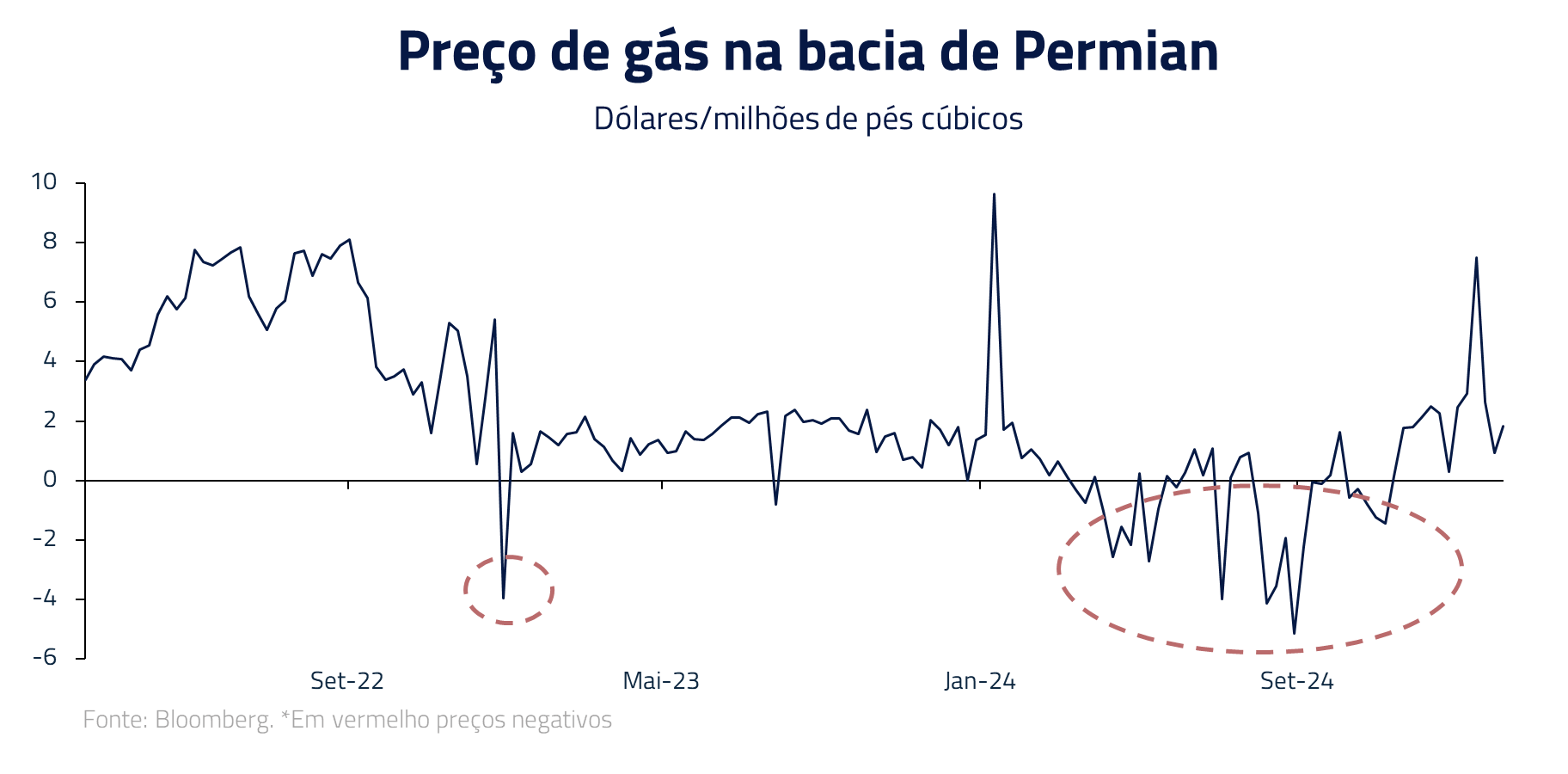

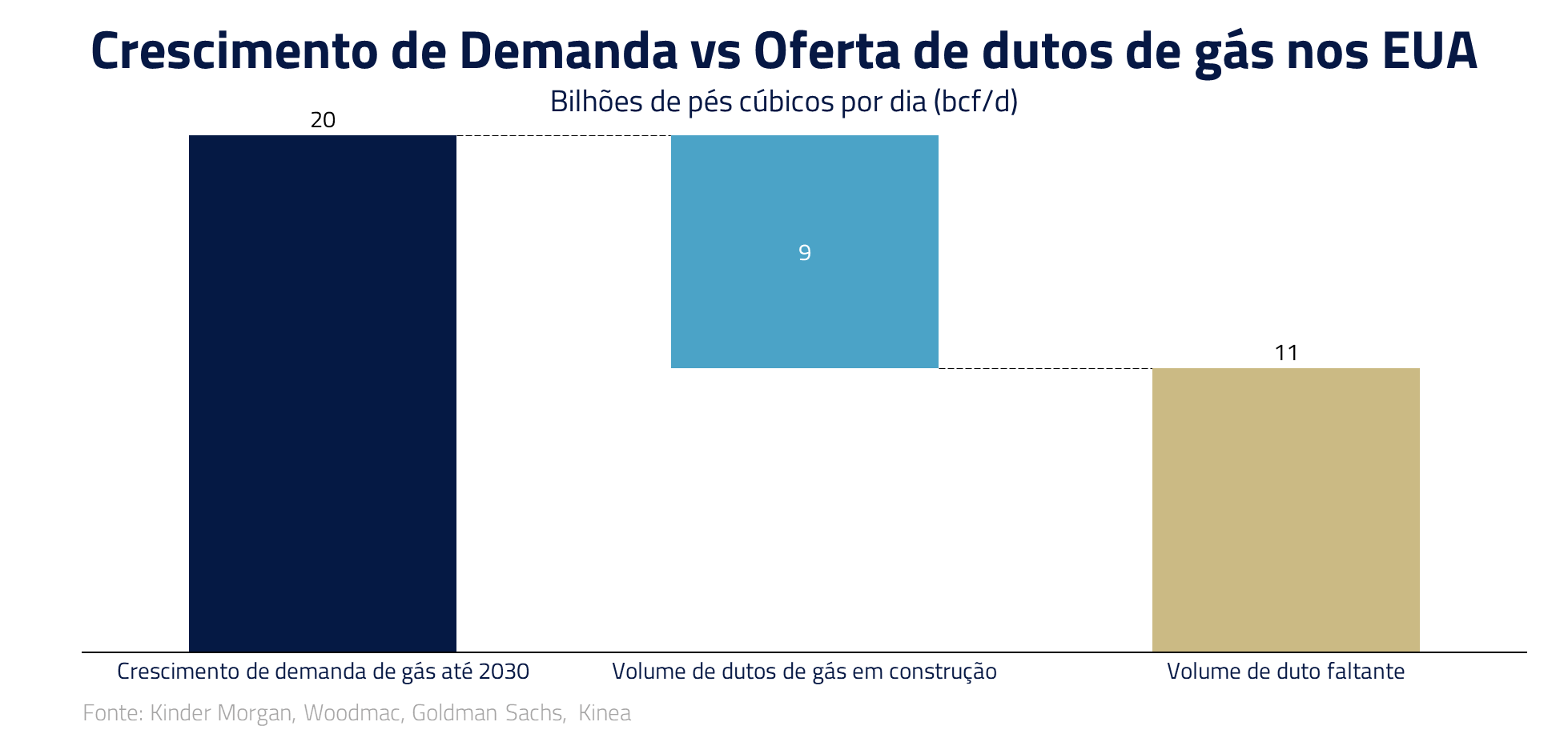

Os Estados Unidos possuem abundante reservas de gás em seu território. Entretanto, em virtude de limitações de licenças para transporte e exportação, o potencial de produção não é integralmente aproveitado. Em certos casos, o preço do gás chega a ser negativo pela impossibilidade de transportá-lo e, consequentemente, necessitar ser queimado no local.

Consideramos, portanto, que haverá necessidade de infraestrutura para que esse gás chegue às novas usinas. Esse setor é conhecido nos Estados Unidos como midstream e compreende empresas como Kinder Morgan e Williams Cos. Além da demanda por novos gasodutos, o governo Trump deve também incentivar a exportação de gás (LNG), o que seria mais um impulso nesse setor onde também estamos investidos.

Chegando o gás nas usinas, agora é a vez das turbinas

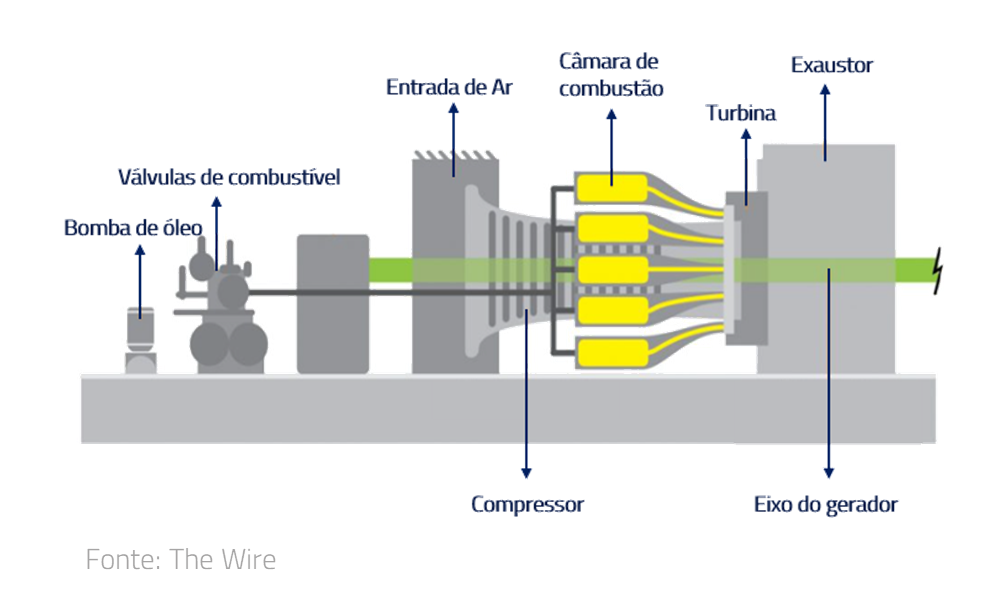

As turbinas a gás são equipamentos que podem custar de 500 mil a mais de 100 milhões de dólares, dependendo de sua capacidade. Seu funcionamento é simples: o ar é puxado para dentro da turbina, misturado com gás natural e queimado sob alta pressão e temperatura, gerando uma explosão. Essa explosão produz gases de alta velocidade que movimentam as pás da turbina, convertendo energia mecânica em elétrica.

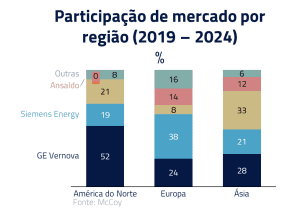

Atualmente, apenas quatro empresas no mundo possuem capacidade para fabricar turbinas a gás voltadas para plantas geradoras: GE Vernova, Siemens Energy, Mitsubishi e Ansaldo. Sendo GE Vernova e Siemens Energy as principais empresas no mercado americano.

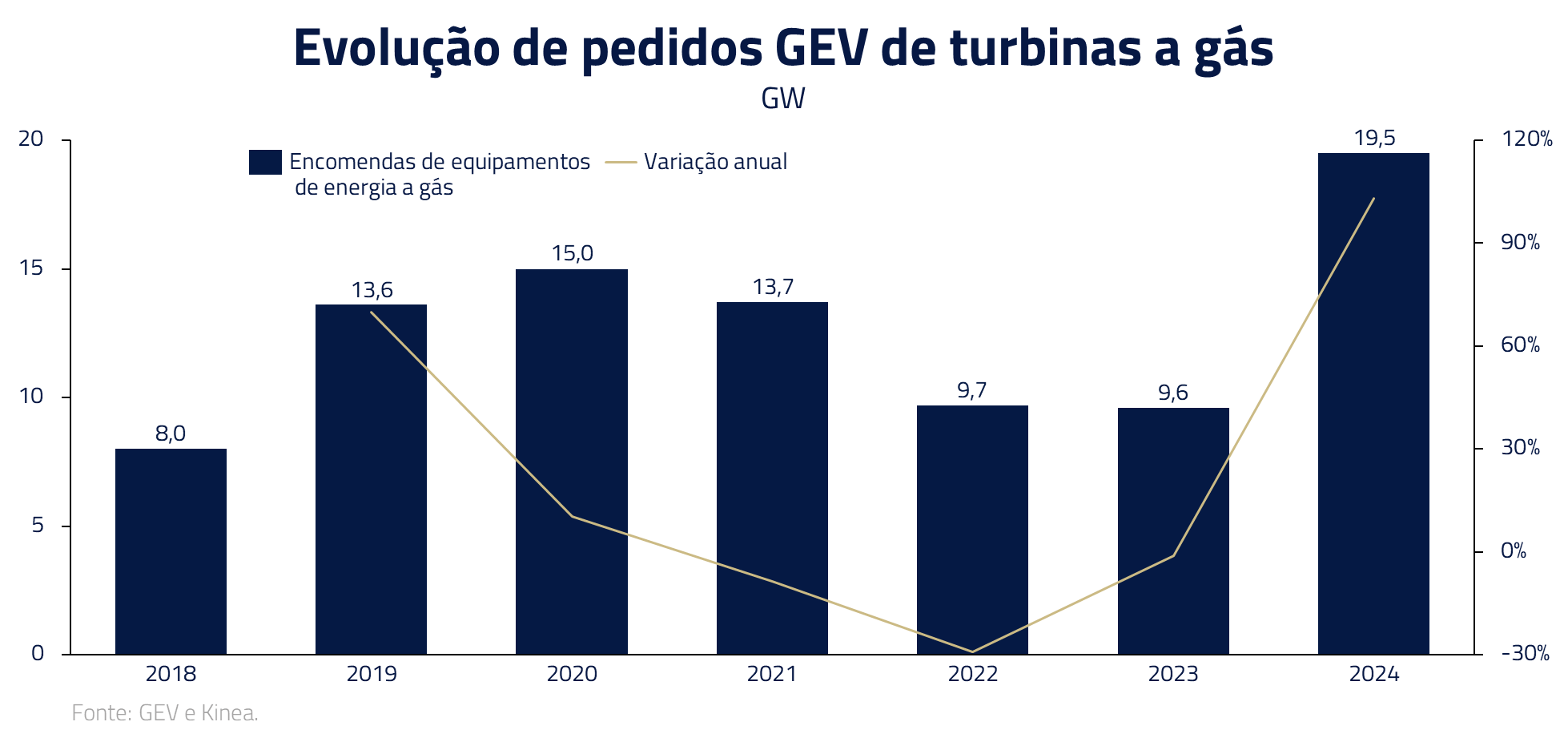

Nas nossas estimativas, temos que a cada 1 GW de demanda adicional, 1 bilhão de dólares será gasto em turbinas a gás, incluindo sua compra e a contratação dos serviços de manutenção. Dado que estimamos 47 GW de demanda adicional nos Estados Unidos por datacenters, isso se traduz em uma oportunidade de 47 bilhões de dólares.

Essa demanda já começa a aparecer nas empresas via aumento de pedidos. No último trimestre, por exemplo, houve um pedido de quase 10 GW na GE Vernova. A companhia comentou que esses pedidos foram todos contratados para projetos nos Estados Unidos.

Em resumo, seguimos bastante construtivos com a demanda por energia e seus desdobramentos na cadeia. Os modelos de raciocínio e os desdobramentos geopolíticos do DeepSeek, na nossa visão, só irão aumentar, e não diminuir, a demanda por datacenters e energia nos EUA. Além disso, acreditamos que as empresas de produtos elétricos, que passam por resfriamento a controle de eletricidade nos datacenters também continuarão sendo beneficiadas por essa tendência.

Receba insights da Kinea exclusivos diretamente no seu e-mail.

Assine nossa newsletter.

Ao assinar a newsletter, você aceita receber comunicados da Kinea e concorda com nossa Política de Privacidade.

***

A jornada rumo à Inteligência Artificial Geral (AGI) reflete a saga épica de O Senhor dos Anéis: repleta de desafios, escolhas morais e o peso do destino em nossas mãos. Assim como os membros da Sociedade do Anel trilharam caminhos distintos para alcançar um objetivo comum, pesquisadores e empresas seguem abordagens diversas na busca pela AGI. Enquanto isso, a rivalidade entre potências como Estados Unidos e China lembra a batalha entre As Duas Torres, onde a luta pelo domínio pode moldar o futuro da sociedade.

No fim, a humanidade terá que fazer sua própria escolha: resistir à tentação de usar a AGI para controle e poder, ou encontrar uma forma de equilibrar seu desenvolvimento para o bem coletivo. Se quisermos evitar o destino de Gollum, obcecado e consumido pelo poder do Anel, precisamos decidir agora como lidaremos com essa tecnologia.

A jornada está apenas começando, mas a responsabilidade de seu desfecho é inteiramente nossa.

Estamos sempre à disposição de nossos clientes e parceiros.

Kinea Investimentos

Saiba onde investir nos fundos Kinea

Entre em contato e saiba como adquirir um de nossos fundos.